Навигация

Сравнительный анализ нейросетевых реализаций алгоритмов распознавания образов

МИНИСТЕРСТВО ОБЩЕГО И ПРОФЕССИОНАЛЬНОГО

ОБРАЗОВАНИЯ РОССИЙСКОЙ ФЕДЕРАЦИИ

РОСТОВСКИЙ ГОСУДАРСТВЕННЫЙ УНИВЕРСИТЕТ

КАФЕДРА БИОФИЗИКИ И БИОКИБЕРНЕТИКИ

ВЫПУСКНАЯ КВАЛИФИКАЦИОННАЯ РАБОТА

на тему:Сравнительный анализнейросетевых реализаций

алгоритмов распознавания образов.

Студент И.Е.Шепелев

Научный руководитель А.И.Самарин

К ЗАЩИТЕ ДОПУСКАЮ

Зав. кафедрой д.б.н,профессор

Б.М.Владимирский

г.Ростов-на-Дону

1998 г.

ОГЛАВЛЕНИЕ

Стр.

Введение 2

Общее описание исследуемых нейронных сетей.

Однослойные сети. Персептрон.

Многослойные сети.

Сети Хопфилда.

Описание программных моделей и алгоритмов их обучения.

Методика и результаты экспериментальных исследований.

Проблема функции ИСКЛЮЧАЮЩЕЕ ИЛИ.

3.2 Исследование представляемости однослойной и двухслойной нейронной сети.

Релаксация стимула.

Возникновение ложного образа. Выработка прототипа.

Бистабильность восприятия.

Заключение.

Литература.

Приложение 1.

Приложение 2.

Введение.

Основным назначением системы распознавания образов является отыскание решения о принадлежности предъявляемых ей образов некоторому классу. Один из важных подходов к задаче предполагает использование разделяющих функций. В условиях, когда мы обладаем лишь немногочисленными априорными сведениями о распознаваемых образах, при построении распознающей системы лучше всего использовать обучающую процедуру. На первом этапе выбираются произвольные разделяющие функции и затем в процессе выполнения итеративных шагов обучения эти разделяющие функции доводятся до оптимального либо приемлемого вида.

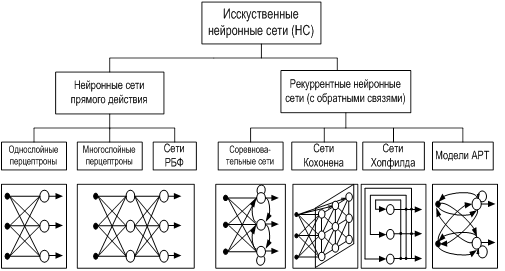

К определению разделяющих функций в настоящее время существует несколько подходов. В данной работе рассматриваются два из них, которые имеют соответствующие нейросетевые реализации. Первый из них - персептронный подход.

В начале 60х годов Минский, Розенблатт, Уиндроу и другие разработали сети, состоящие из одного слоя искусственных нейронов. Часто называемые персептронами, они были использованы для широкого класса задач, в том числе и искусственного зрения. Однако Минский и Пайперт [2] доказали, что используемые в то время однослойные сети теоретически неспособны решить многие простые задачи.

Сети обратного распространения - наиболее успешный, по-видимому, из современных алгоритмов, преодолевает ограничения, указанные Минским. Обратное распространение является систематическим методом для обучения многослойных сетей.

Второй подход при определении разделяющих функций использует понятие потенциальной энергии. Так Хопфилдом [7] в задаче о релаксации некоторого начального состояния к одному из устойчивых состояний нейронной сети было введено понятие потенциальной энергии, которая уменьшалась в процессе релаксации. Соответствующие нейронные сети известны в литературе как сети Хопфилда. Это сети с обратными связями, которые в связи с этим обладают некоторыми свойствами, заслуживающими внимания.

На этапе бакалаврской работы цель состояла в создании компьютерных моделей указанных выше нейронных сетей и анализе некоторых свойств, связанных с их обучением и распознаванием ими образов.

1.Общее описание исследуемых нейронных сетей.

Однослойные сети. Персептрон.

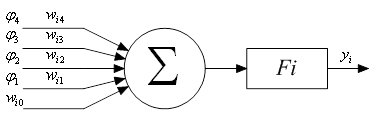

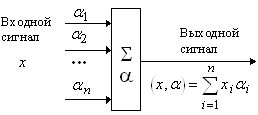

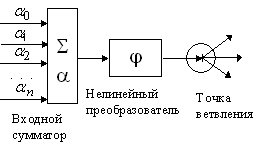

В соответствии с [3] персептрон представляет собой модель обучаемой распознающей системы. Он содержит матрицу светочувствительных элементов (S-элементы), ассоциативные элементы (А-элементы) и реагирующие элементы (R-элементы). По сути персептрон состоит из одного слоя искусственных нейронов, соединенных с помощью весовых коэффициентов с множеством входов.

В 60е годы персептроны вызвали большой интерес. Розенблатт [3] доказал теорему об обучении персептрона и тем самым показал, что персептрон способен научиться всему, что он способен представлять. Уидроу [12-15] дал ряд убедительных демонстраций систем персептронного типа. Исследования возможности этих систем показали, что персептроны не способны обучиться ряду простых задач. Минский [2] строго проанализировал эту проблему и показал, что имеются жесткие ограничения на то, что могут выполнять однослойные персептроны, и, следовательно, на то, чему они могут обучаться.

Один из самых пессимистических результатов Минского показывает, что однослойный персептрон не может воспроизвести такую простую функцию как ИСКЛЮЧАЮЩЕЕ ИЛИ. Это - функция от двух аргументов, каждый из которых может быть нулем или единицей. Она принимает значение единицы, когда один из аргументов равен единице (но не оба). Если проблему представить с помощью однослойной однонейронной системы, то легко видеть, что при любых значениях весов и порогов невозможно расположить прямую линию, разделяющую плоскость (пространство образов) так, чтобы реализовывалась функция ИСКЛЮЧАЮЩЕЕ ИЛИ. Имеется обширный класс функций (наряду с функцией ИСКЛЮЧАЮЩЕЕ ИЛИ), не реализуемых однослойной сетью. Об этих функциях говорят, что они являются линейно неразделимыми, и они накладывают определенные ограничения на возможности однослойных сетей. Линейная разделимость ограничивает однослойные сети задачами классификации, в которых множества точек (соответствующих входным значениям) могут быть разделены геометрически. В случае двух входов разделитель является прямой линией. В случае трех входов разделение осуществляется плоскостью, рассекающей трехмерное пространство. Для четырех или более входов визуализация невозможна и необходимо мысленно представить n-мерное пространство, рассекаемое ‘‘гиперплоскостью’’ - геометрическим объектом, который рассекает пространство четырех или большего числа измерений. Как показано в [11], вероятность того, что случайно выбранная функция окажется линейно разделимой, весьма мала. Так как линейная разделимость ограничивает возможности персептронного представления, то однослойные персептроны на практике ограничены простыми задачами.

Чтобы сеть представляла практическую ценность, нужен систематический метод (алгоритм) для вычисления значений весов и порогов. Процедуру подстройки весов обычно называют обучением. Цель обучения состоит в том, чтобы для некоторого множества входов давать желаемое множество выходов. Алгоритм обучения персептрона был предложен в [3] и имеет множество модификаций. В настоящей работе реализованна модель одного из вариантов.

Многослойные сети.

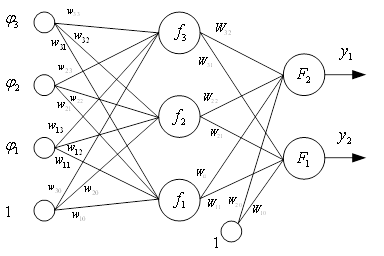

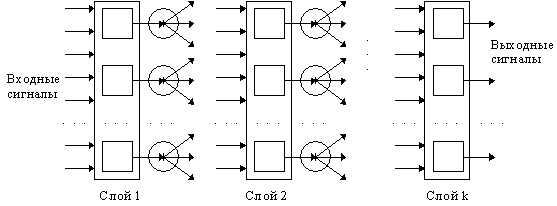

Серьезное ограничение представляемости однослойными сетями можно преодолеть, добавив дополнительные слои. Многослойные сети можно получить каскадным соединением однослойных сетей, где выход одного слоя является входом для последующего слоя, причем такая сеть может привести к увеличению вычислительной мощности лишь в том случае, если активационная функция между слоями будет нелинейной.

Многослойные сети способны выполнять общие классификации, отделяя те точки, которые содержаться в выпуклых ограниченных или неограниченных областях. Если рассмотреть простую двухслойную сеть с двумя нейронами в первом слое, соединенными с единственным нейроном во втором слое, то каждый нейрон первого слоя разбивает плоскость на две полуплоскости, образуя в пространстве образов V-образную область, а нейрон второго слоя реализует различные функции при подходящем выборе весов и порога. Аналогично во втором слое может быть использовано три нейрона с дальнейшим разбиением плоскости и созданием области треугольной формы. Включением достаточного числа нейронов во входной слой может быть образован выпуклый многоугольник любой желаемой формы. Точки, не составляющие выпуклой области, не могут быть отделены о других точек плоскости двухслойной сетью.

Трехслойная сеть является более общей. Ее классифицирующие возможности ограничены лишь числом искусственных нейронов и весов. Ограничения на выпуклость отсутствуют. Теперь нейрон третьего слоя принимает в качестве входа набор выпуклых многоугольников, и их логическая комбинация может быть невыпуклой. При добавлении нейронов и весов число сторон многоугольника может неограниченно возрастать. Это позволяет аппроксимировать область любой формы с любой точностью. В добавок не все выходные области второго слоя должны пересекаться. Возможно, следовательно, объединять различные области, выпуклые и невыпуклые, выдавая на выходе единицу всякий раз, когда входной вектор принадлежит одной из них.

Для обучения искусственных нейронных сетей широко применяется процедура обратного распространения. Обратное распространение было независимо предложено в трех различных работах [8, 9, 10]. В работе программно реализованна двухслойная сеть обратного распространения.

Похожие работы

... МП к некритическому экстраполированию результата считается его слабостью. Сети РБФ более чувствительны к «проклятию размерности» и испытывают значительные трудности, когда число входов велико. 5. МОДЕЛИРОВАНИЕ НЕЙРОННЫХ СЕТЕЙ ДЛЯ ПРОГНОЗИРОВАНИЯ СТОИМОСТИ НЕДВИЖИМОСТИ 5.1 Особенности нейросетевого прогнозирования в задаче оценки стоимости недвижимости Использование нейронных сетей можно ...

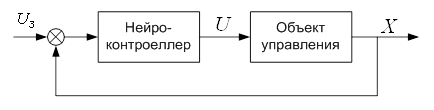

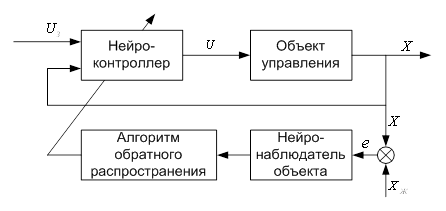

... и необходимостью специальной подготовки потенциальных пользователей для оптимальной организации адаптивного процесса. В то же время широкое распространение могут получить обученные аналоговые нейрокомпьютеры (нейросети) с фиксированной или незначительно подстраиваемой структурой связей – нейропроцессоры. Задача создания нейропроцессоров сводится к обучению цифровой нейросетевой модели нужному ...

... экспертных систем (А. Батуро), а также лекции проф. А.Н. Горбаня по нейронным сетям. Приложение 1. Плакаты для защиты диплома. ТЕХНОЛОГИЯ ИЗВЛЕЧЕНИЯ ЗНАНИЙ ИЗ НЕЙРОННЫХ СЕТЕЙ: ¨ АПРОБАЦИЯ, ¨ ПРОЕКТИРОВАНИЕ ПО, ¨ ИСПОЛЬЗОВАНИЕ В ПСИХОЛИНГВИСТИКЕ ЦЕЛЬ РАБОТЫ ¨ апробация гибкой технологии извлечения ...

... является важнейшим слагаемым политической стабильности»). Именно нейросетевая технология производства знаний, по-моему, является «точкой роста», которая по-новому развернет нейроинформатику, преобразует многие разделы информатики и создаст новые. Примеры приложений Насколько мы можем судить по открытой печати, приложения нейронных сетей распределены примерно следующим образом: более 60% ...

0 комментариев