Министерство образования и науки РФ

Череповецкий государственный университет

Инженерно-экономический институт

Реферат

Понятие случайного процесса в математике

Выполняла студентка

группы 5 ГМУ-21

Иванова Юлия

Череповец

2009

Содержание

Введение

Основная часть

· Определение случайного процесса и его характеристики

· Марковские случайные процессы с дискретными состояниями

· Стационарные случайные процессы

· Эргодическое свойство стационарных случайных процессов

Литература

Введение

Понятие случайного процесса введено в XX столетии и связано с именами А.Н. Колмогорова (1903-1987), А.Я. Хинчина (1894-1959), Е.Е. Слуцкого (1880-1948), Н. Винера (1894-1965).

Это понятие в наши дни является одним из центральных не только в теории вероятностей, но также в естествознании, инженерном деле, экономике, организации производства, теории связи. Теория случайных процессов принадлежит к категории наиболее быстро развивающихся математических дисциплин. Несомненно, что это обстоятельство в значительной мере определяется ее глубокими связями с практикой. XX век не мог удовлетвориться тем идейным наследием, которое было получено от прошлого. Действительно, в то время, как физика, биолога, инженера интересовал процесс, т.е. изменение изучаемого явления во времени, теория вероятностей предлагала им в качестве математического аппарата лишь средства, изучавшие стационарные состояния.

Для исследования изменения во времени теория вероятностей конца XIX - начала XX века не имела ни разработанных частных схем, ни тем более общих приемов. А необходимость их создания буквально стучала в окна и двери математической науки. Изучение броуновского движения в физике подвело математику к порогу создания теории случайных процессов.

Считаю необходимым упомянуть еще о двух важных группах исследований, начатых в разное время и по разным поводам.

Во-первых, эта работы А.А. Маркова (1856-1922) по изучению цепных зависимостей. Во-вторых, работы Е.Е. Слуцкого (1880-1948) по теории случайных функций.

Оба этих направления играли очень существенную роль в формировании общей теории случайных процессов.

Для этой цели уже был накоплен значительный исходный материал, и необходимость построения теории как бы носились в воздухе.

Оставалось осуществить глубокий анализ имеющихся работ, высказанных в них идей и результатов и на его базе осуществить необходимый синтез.

Определение случайного процесса и его характеристики

Определение: Случайным процессом X(t) называется процесс, значение которого при любом значении аргумента t является случайной величиной.

Другими словами, случайный процесс представляет собой функцию, которая в результате испытания может принять тот или иной конкретный вид, неизвестный заранее. При фиксированном t=t0 X(t0) представляет собой обычную случайную величину, т.е. сечение случайного процесса в момент t0.

Примеры случайных процессов:

1. численность населения региона с течением времени;

2. число заявок, поступающих в ремонтную службу фирмы, с течением времени.

Случайный процесс можно записать в виде функции двух переменных X(t,ω), где ω?Ω, t?T, X(t, ω) ? ≡ и ω – элементарное событие, Ω - пространство элементарных событий, Т – множество значений аргумента t, ≡ - множество возможных значений случайного процесса X(t, ω).

Реализацией случайного процесса X(t, ω) называется неслучайная функция x(t), в которую превращается случайный процесс X(t) в результате испытания (при фиксированном ω), т.е. конкретный вид, принимаемый случайным процессом X(t), его траектория.

Таким образом, случайный процесс X(t, ω) совмещает в себе черты случайной величины и функции. Если зафиксировать значение аргумента t, случайный процесс превращается в обычную случайную величину, если зафиксировать ω, то в результате каждого испытания он превращается в обычную неслучайную функцию. В дальнейшем изложении опустим аргумент ω, но он будет подразумеваться по умолчанию.

На рисунке 1 изображено несколько реализаций некоторого случайного процесса. Пусть сечение этого процесса при данном t является непрерывной случайной величиной. Тогда случайный процесс X(t) при данном t определяется полностью вероятности φ(x‚ t). Очевидно, что плотность φ(x, t) не является исчерпывающим описанием случайного процесса X(t), ибо она не выражает зависимости между его сечениями в разные моменты времени.

Случайный процесс X(t) представляет собой совокупность всех сечений при всевозможных значений t, поэтому для его описания необходимо рассматривать многомерную случайную величину (X(t1), X(t2), …, X(tn)), состоящей из всех сочетаний этого процесса. В принципе таких сочетаний бесконечно много, но для описания случайного процесса удаётся часть обойтись относительно небольшим количеством сочетаний.

Говорят, что случайный процесс имеет порядок n, если он полностью определяется плотностью совместного распределения φ(x1, x2, …, xn; t1, t2, …, tn) n произвольных сечений процесса, т.е. плотностью n-мерной случайной величины (X(t1), X(t2), …, X(tn)), где X(ti) – сочетание случайного процесса X(t) в момент времени ti, i=1, 2, …, n.

Как и случайная величина, случайный процесс может быть описан числовыми характеристиками. Если для случайной величины эти характеристики являются постоянными числами, то для случайного процесса – неслучайными функциями.

Математическим ожиданием случайного процесса X(t) называется неслучайная функция ax(t), которая при любом значении переменной t равна математическому ожиданию соответствующего сечения случайного процесса X(t), т.е. ax(t)=М [X(t)].

Дисперсией случайного процесса X(t) называется неслучайная функция Dx(t), при любом значении переменной t равная дисперсии соответствующего сочетания случайного процесса X(t), т.е. Dx(t)= D[X(t)].

Средним квадратическим отклонением σx(t) случайного процесса X(t) называется арифметическое значение корня квадратного из его дисперсии, т.е. σx(t)= Dx(t).

Математическое ожидание случайного процесса характеризует среднюю траекторию всех возможных его реализаций, а его дисперсия или среднее квадратическое отклонение - разброс реализаций относительно средней траектории.

Введённых выше характеристик случайного процесса оказывается недостаточно, так как они определяются только одномерным законом распределения. Если для случайного процесса Х1(t) характерно медленное изменение значений реализаций с изменением t, то для случайного процесса Х2(t) это изменение проходит значительно быстрее. Другими словами, для случайного процесса Х1(t) характерна тесная вероятностная зависимость между двумя его сочетаниями Х1(t1) и Х1(t2), в то время как для случайного процесса Х2(t) эта зависимость между сочетаниями Х2(t1) и Х2(t2) практически отсутствует. Указанная зависимость между сочетаниями характеризуется корреляционной функцией.

Определение: Корреляционной функцией случайного процесса Х(t) называется неслучайная функция

Kx(t1, t2) = M[(X(t1) – ax(t1))(X(t2) – ax(t2))] (1.)

двух переменных t1 и t2 , которая при каждой паре переменных t1 и t2 равна ковариации соответствующих сочетаний Х(t1) и Х(t2) случайного процесса.

Очевидно, для случайного процесса Х(t1) корреляционная функция Kx1(t1, t2) убывает по мере увеличения разности t2 - t1 значительно медленнее, чем Kx2(t1, t2) для случайного процесса Х(t2).

Корреляционная функция Kx(t1, t2) характеризует не только степень тесноты линейной зависимости между двумя сочетаниями, но и разброс этих сочетаний относительно математического ожидания ax(t). Поэтому рассматривается также нормированная корреляционная функция случайного процесса.

Нормированной корреляционной функцией случайного процесса Х(t) называется функция:

Px(t1, t2) = Kx(t1, t2) / σx(t1)σx(t2) (2)

Пример № 1

Случайный процесс определяется формулой X(t) = X cosωt, где Х – случайная величина. Найти основные характеристики этого процесса, если М(Х) = а, D(X) = σ2.

РЕШЕНИЕ:

На основании свойств математического ожидания и дисперсии имеем:

ax(t) = M(X cosωt) = cosωt * M(X) = a cosωt,

Dx(t) = D(X cosωt) = cos2ωt * D(X) = σ2 cos2 ωt.

Корреляционную функцию найдём по формуле (1.)

Kx(t1, t2) = M[(X cosωt1 – a cosωt1) (X cos ωt2 – a cosωt2)] =

= cosωt1 cosωt2 * M[(X – a)(X - a)] = cosωt1 cosωt2 * D(X) = σ2 cosωt1 cosωt2.

Нормированную корреляционную функцию найдём по формуле (2.):

Px(t1, t2) = σ2 cosωt1 cosωt2 / (σ cosωt1)( σ cosωt2) ≡ 1.

Случайные процессы можно классифицировать в зависимости от того, плавно или скачкообразно меняются состояния системы, в которой они протекают, конечно (счетно) или бесконечно множество этих состояний и т.п. Среди случайных процессов особое место принадлежит Марковскому случайному процессу.

Теорема. Случайный процесс X(t) является гильбертовым тогда и только тогда, когда существует R(t, t’) для всех (t, t’)? T*T.

Теорию гильбертовых случайных процессов называют корреляционной.

Заметим, множество Т может быть дискретным и континуальным. В первом случае случайный процесс Хtназывают процессом с дискретным временем, во втором – с непрерывным временем.

Соответственно сочетания Хt могут быть дискретными и непрерывными случайными величинами.

Случайный процесс называется Х(t) выборочно неправильным, дифференцируемым и интегрируемым в точке ω?Ω, если его реализация x(t) = x(t, ω) соответственно непрерывна, дифференцируема и интегрируема.

Случайный процесс Х(t) называется непрерывным: почти, наверное, если

P(A)=1, A = {ω ? Ω : lim x(tn) = x(t)}

В среднем квадратическом, если

Lim M[(X(tn) – X(t))2] = 0

По вероятности, если

Aδ ≥ 0 : lim P[| X(tn) – X(t)| > δ] = 0

Сходимость в среднем квадратическом обозначают также:

X(t) = lim X(tn)

Оказывается, из выборочной непрерывности следует непрерывность почти наверное, из непрерывности почти наверное и в среднем квадратическом следует непрерывность по вероятности.

Теорема. Если X(t) – гильбертов случайный процесс, непрерывный в среднем квадратическом, то mx(t) – непрерывная функция и имеет место соотношение

Lim M [X(tn)] = M [X(t)] = M [lim X(tn)].

Теорема. Гильбертов случайный процесс X(t) непрерывен в среднем квадратическом тогда и только тогда, когда непрерывна его ковариационная функция R(t, t’) в точке (t, t).

Гильбертов случайный процесс X(t) называется дифференцируемым в среднем квадратическом, если существует случайная функция X(t) = dX(t)/dt такая, что

X(t) = dX(t)/ dt = lim X(t+∆t) – X(t) / ∆t

(t ? T, t +∆t ? T),

т.е. когда

Lim M [((X(t + ∆t) – X(t) / (∆t)) – X(t))2] = 0

Случайную функцию X(t) будем называть производной в среднем квадратическом случайного процесса X(t) соответственно в точке t или на T.

Теорема. Гильбертов случайный процесс X(t) дифференцируем в среднем квадратическом в точке t тогда и только тогда, когда существует

δ2 R(t, t’) / δtδt’ в точке (t, t’). При этом:

Rx(t, t’) = M[X(t)X(t’)] = δ2 R(t, t’) / δtδt’.

Если гильбертов случайный процесс дифференцируем на Т, то его производная в среднем квадратическом также является гильбертовым случайным процессом; если выборочные траектории процесса дифференцируемы на Т с вероятностью 1, то с вероятностью 1 их производные совпадают с производными в среднем квадратическом на Т.

Теорема. Если X(t) - гильбертов случайный процесс, то

M[dX(t) / dt] = (d / dt) M[X(t)] = dmx(t) / dt.

Пусть (0, t) – конечный интервал, 0 <t1 < … <tn = t – его точки

X(t) - гильбертов случайный процесс.

Yn = ∑ X(ti)(ti – ti-1) (n = 1,2, …).

Тогда случайная величина

Y(t) = lim Yn

max (ti – ti-1)→0

Называется интегралом в среднем квадратическом процесса X(t) на (0, t) и обозначается:

Y(t) = ∫ X(τ)dτ.

Теорема. Интеграл Y(t) в среднем квадратическом существует тогда и только тогда, когда ковариационная функция R(t, t’) гильбертова процесса X(t) непрерывна на Т×Т и существует интеграл

Ry(t, t’) = ∫ ∫ R(τ, τ’) dτdτ’

Если интеграл в среднем квадратическом функции X(t) существует, то

M[Y(t)] = ∫ M[X(τ)]dτ,

RY(t, t’) = ∫ ∫ R(τ, τ’)dτdτ’

Ky(t, t’) = ∫ ∫ K(τ, τ’)dτdτ’

Здесь Ry(t, t’) = M[Y(t)Y(t’)], Ky(t, t’) = M[Y(t)Y(t’)] – ковариационная и корреляционная функции случайного процесса Y(t).

Теорема. Пусть X(t) – гильбертов случайный процесс с ковариационной функцией R(t, t’), φ(t) – вещественная функция и существует интеграл

∫ ∫ φ(t)φ(t’)R(t, t’)dtdt’

Тогда существует в среднем квадратическом интеграл

∫ φ(t)X(t)dt.

Случайные процессы:

Xi(t) = Viφi(t) (i = 1n)

Где φi(t) – заданные вещественные функции

Vi- случайные величины с характеристиками

M(VI = 0), D(VI) = DI, M(ViVj) = 0 (i ≠ j)

Называют элементарными.

Каноническим разложением случайного процесса X(t) называют его представление в виде

X(t) = mx(t) + ∑ Viφi(t) (t ? T)

Где Vi – коэффициенты, а φi(t) – координатные функции канонического разложения процесса X(t).

Из отношений:

M(VI = 0), D(VI) = DI, M(ViVj) = 0 (i ≠ j)

X(t) = mx(t) + ∑ Viφi(t) (t ? T)

Следует:

K(t, t’) = ∑ Diφi(t)φi(t’)

Эту формулу называют каноническим разложением корреляционной функции случайного процесса.

В случае уравнения

X(t) = mx(t) + ∑ Viφi(t) (t ? T)

Имеют место формулы:

X(t) = mx(t) + ∑ Viφ(t)

∫ x(τ)dt = ∫ mx(τ)dτ + ∑ Vi ∫ φi(t)dt.

Таким образом, если процесс X(t) представлен его каноническим разложением, то производная и интеграл от него также могут быть представлены в виде канонических разложений.

Марковские случайные процессы с дискретными состояниями

Случайный процесс, протекающий в некоторой системе S с возможными состояниями S1, S2, S3, …, называется Марковским, или случайным процессом без последствия, если для любого момента времени t0 вероятные характеристики процесса в будущем (при t>t0) зависит только от его состояния в данный момент t0 и не зависят от того, когда и как система пришла в это состояние; т.е. не зависят от её поведения в прошлом (при t<t0).

Примером Марковского процесса: система S – счётчик в такси. Состояние системы в момент t характеризуется числом километров (десятых долей километров), пройденных автомобилем до данного момента. Пусть в момент t0 счётчик показывает S0/ Вероятность того, что в момент t>t0 счётчик покажет то или иное число километров (точнее, соответствующее число рублей) S1 зависит от S0, но не зависит от того, в какие моменты времени изменились показания счётчика до момента t0.

Многие процессы можно приближенно считать Марковскими. Например, процесс игры в шахматы; система S – группа шахматных фигур. Состояние системы характеризуется числом фигур противника, сохранившихся на доске в момент t0. Вероятность того, что в момент t>t0 материальный перевес будет на стороне одного из противников, зависит в первую очередь от того, в каком состоянии находится система в данный момент t0, а не от того, когда и в какой последовательности исчезли фигуры с доски до момента t0.

В ряде случаев предысторией рассматриваемых процессов можно просто пренебречь и применять для их изучения Марковские модели.

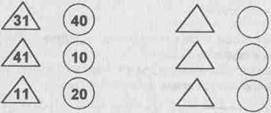

Марковским случайным процессом с дискретными состояниями и дискретным временем (или цепью Маркова) называется Марковский процесс, в котором его возможные состояния S1, S2, S3, … можно заранее перечислить, а переход из состояния в состояние происходит мгновенно (скачком), но только в определённые моменты времени t0, t1, t2, ..., называемые шагами процесса.

Обозначим pij – вероятность перехода случайного процесса (системы S) из состояния I в состояние j. Если эти вероятности не зависят от номера шага процесса, то такая цепь Маркова называется однородной.

Пусть число состояний системы конечно и равно m. Тогда её можно характеризовать матрицей перехода P1, которая содержит все вероятности перехода:

p11 p12 … p1m

p21 p22 … p2m

… … … …

Pm1 pm2 … pmm

Естественно, по каждой строке ∑ pij = 1, I = 1, 2, …, m.

Обозначим pij(n) – вероятностью того, что в результате n шагов система перейдёт из состояния I в состояние j. При этом при I = 1 имеем вероятности перехода, образующие матрицу P1, т.е. pij(1) = pij

Необходимо, зная вероятности перехода pij, найти pij(n) – вероятности перехода системы из состояния I в состояние j за n шагов. С этой целью будем рассматривать промежуточное (между I и j) состояние r, т.е. будем считать, что из первоначального состояния I за k шагов система перейдёт в промежуточное состояние r с вероятностью pir(k), после чего за оставшиеся n-k шагов из промежуточного состояния r она перейдёт в конечное состояние j с вероятностью prj(n-k). Тогда по формуле полной вероятности

Pij(n) = ∑ pir (k) prj (n-k) – равенство Маркова.

Убедимся в том, что, зная все вероятности перехода pij = pij(1), т.е. матрицу P1 перехода из состояния в состояние за один шаг, можно найти вероятность pij(2), т.е. матрицу P2 перехода из состояния в состояние за два шага. А зная матрицу P2, - найти матрицу P3 перехода из состояния в состояние за три шага, и т.д.

Действительно, полагая n = 2 в формуле Pij(n) = ∑ pir (k) prj (n-k), т.е. k=1 (промежуточное между шагами состояние), получим

Pij(2) = ∑ pir(1)prj (2-1) = ∑ pir prj

Полученное равенство означает, что P2 =P1P1 = P21

Полагая n = 3, k = 2, аналогично получим P3 = P1P2 = P1P12 = P13, а в общем случае Pn= P1n

Пример

Совокупность семей некоторого региона можно разделить на три группы:

1. семьи, не имеющие автомобиля и не собирающиеся его покупать;

2. семьи, не имеющие автомобиля, но намеревающиеся его приобрести;

3. семьи, имеющие автомобиль.

Проведённое статистическое обследование показало, что матрица перехода за интервал в один год имеет вид:

0,8 0,1 0,1

0 0,7 0,3

0 0 1

(В матрице P1 элемент р31 = 1 означает вероятность того, что семья, имеющая автомобиль, также будет его иметь, а, например, элемент р23 = 0,3 – вероятность того, что семья, не имевшая автомобиля, но решившая его приобрести, осуществит своё намерение в следующем году, и т.д.)

Найти вероятность того, что:

1. семья, не имевшая автомобиля и е собиравшаяся его приобрести, будет находиться в такой же ситуации через два года;

2. семья, не имевшая автомобиля, но намеревающаяся его приобрести, будет иметь автомобиль через два года.

РЕШЕНИЕ: найдём матрицу перехода Р2 через два года:

0,8 0,1 0,1 0,8 0,1 0,1 0,64 0,15 0,21

0 0,7 0,3 0 0,7 0,3 0 0,49 0,51

0 0 1 0 0 1 0 0 1

То есть искомые в примере 1) и 2) вероятности равны соответственно

р11 =0,64, р23 =0,51

Далее рассмотрим Марковский случайный процесс с дискретными состояниями и непрерывным временем, в котором, в отличие от рассмотренной выше цепи Маркова, моменты возможных переходов системы из состояния не фиксированы заранее, а случайны.

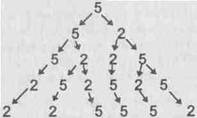

При анализе случайных процессов с дискретными состояниями удобно пользоваться геометрической схемой – так называемым графиком событий. Обычно состояния системы изображаются прямоугольниками (кружками), а возможные переходы из состояния в состояние – стрелками (ориентированными дугами), соединяющими состояния.

Пример. Построить граф состояний следующего случайного процесса: устройство S состоит из двух узлов, каждый из которых в случайный момент времени может выйти из строя, после чего мгновенно начинается ремонт узла, продолжающийся заранее неизвестное случайное время.

РЕШЕНИЕ. Возможные состояния системы: S0 – оба узла исправны; S1 – первый узел ремонтируется, второй исправен; S2 – второй узел ремонтируется, первый исправен; S3 – оба узла ремонтируются.

Стрелка, направления, например, из S0 в S1, означает переход системы в момент отказ первого узла, из S1 в S0 – переход в момент окончания ремонта этого узла.

На графе отсутствуют стрелки из S0 в S3 и из S1 в S2. Это объясняется тем, что выходы узлов из строя предполагается независимыми друг от друга и, например, вероятностями одновременного выхода из строя двух узлов (переход из S0 в S3) или одновременного окончания ремонтов двух узлов (переход из S3 в S0) можно пренебречь.

Стационарные случайные процессы

Случайный процесс Х(t) называют стационарным в узком смысле, если

F(x1, …, xn; t1, …, tn) = F(x1, …, xn; t1+∆, …, tn+∆)

При произвольных

n≥1, x1, …, xn, t1, …, tn; ∆; t1 ? T, ti + ∆ ? T.

Здесь F(x1, …, xn; t1, …, tn) – n-мерная функция распределения случайного процесса Х(t).

Случайный процесс Х(t) называют стационарным в широком смысле, если

m(t) = m(t + ∆), K(t, t’) = K(t + ∆, t’ + ∆)

(t ? T, t’ ? T, t + ∆? T), t’ + ∆? T)

Очевидно, что из стационарности в узком смысле следует стационарность в широком смысле.

Из формул:

m(t) = m(t + ∆), K(t, t’) = K(t + ∆, t’ + ∆)

(t ? T, t’ ? T, t + ∆? T), t’ + ∆? T)

Следует, что для процесса, стационарного в широком смысле, можно записать

m (t) = mx(0) = const;

D (t) = K(t, t) = K(0,0) = const;

K(t, t’) = K(t – t’, 0) = K (0, t’ - t)

Таким образом, для процесса, стационарного в широком смысле, математическое ожидание и дисперсия не зависят от времени, а K(t, t’) представляет собою функцию вида:

K(t, t’) = k(τ) = k(-τ), τ = t’ – t.

Видно, что k(τ) – чётная функция, при этом

K(0) = В = σ2; |k(τ)| ≤ k(0); ∑ ∑ άiαjk(ti - tj) ≥ 0

Здесь D – дисперсия стационарного процесса

Х(t), αi (I = 1, n) – произвольные числа.

Первое равенство системы

K(0) = В = σ2; |k(τ)| ≤ k(0); ∑ ∑ άiαjk(ti - tj) ≥ 0

следует из уравнения K(t, t’) = k(τ) = k(-τ), τ = t’ – t. Первое равенство

K(0) = В = σ2; |k(τ)| ≤ k(0); ∑ ∑ άiαjk(ti - tj) ≥ 0 - простое следствие неравенства Шварца для сечений X(t), X(t’) стационарного случайного процесса X(t). Последнее неравенство:

K(0) = В = σ2; |k(τ)| ≤ k(0); ∑ ∑ άiαjk(ti - tj) ≥ 0

Получают следующим образом:

∑ ∑ αi αjk(ti - tj) = ∑ ∑ K(ti, tj)αi αj = ∑ ∑ M[(αiXi)(αjXj)] = M[(∑ αiXi)2] ≥0

Учитывая формулу корреляционной функции производной dX(t)/dt случайного процесса, для стационарной случайной функции X(t) получим

K1(t, t’) = M[(dX(t)/dt)*(dX(t’)/dt’)] = δ2K(t, t’) / δtδt’ = δ2k(t’ - t) / δtδt’

Поскольку

δk(t’ - t) / δt = (δk(τ) / δτ) * (δτ / δτ) = - δk(τ) / δτ,

δ2k(t’ - t) / δtδt’ = - (δ2 k(τ) / δτ2) * (δτ / δt’) = - (δ2 k(τ) / δτ2)

то K1(t, t’) = k1(τ) = - (δ2 k(τ) / δτ2), τ = t’ – t.

Здесь K1(t, t’) и k1(τ) – корреляционная функция первой производной стационарного случайного процесса X(t).

Для n-й производной стационарного случайного процесса формула корреляционной функции имеет вид:

Kn(τ) = (-1)n * (δ2n *k(τ) / δτ2n)

Теорема. Стационарный случайный процесс X(t) с корреляционной функцией k(τ) непрерывен в среднем квадратическом в точке t ? T тогда и только тогда, когда

Lim k(τ) = k(0)

Для доказательства запишем очевидную цепочку равенств:

M [|X(t+τ)-X(T)|2] = M[|X(t)|2] – 2M[|X(t+τ)X(t)|] + M[X(t)2] =

= 2D-2k(τ) = 2[k(0)-k(τ)].

Отсюда очевидно, что условие непрерывности в среднем квадратическом процесса X(t) в точке t ? T

Lim M[|X(t+τ) – X(t)|2] = 0

Имеет место тогда и только тогда, когда выполняется Lim k(τ) = k(0)

Теорема. Если корреляционная функция k(τ) стационарного случайного процесса X(t) непрерывна в среднем квадратическом в точке τ=0, то она непрерывна в среднем квадратическом в любой точке τ ? R1.

Для доказательства запишем очевидные равенства:

k(τ+∆τ)-k(τ) = M[X(t+τ+∆τ)X(t)] – M[X(t+τ)X(t)] =

= M{X(t)[X(t+τ+∆τ) – X(t+τ)]}

Затем, применяя неравенство Шварца к сомножителям в фигурной скобке и учитывая соотношения:

K(t, t’) = k(τ) = k(-τ), τ = t’ – t.

K(0) = В = σ2; |k(τ)| ≤ k(0); ∑ ∑ άiαjk(ti - tj) ≥ 0

Получим:

0 ≤ [k(τ+∆τ)-k(τ)]2≤ M[X(t)2]M[|X(t+τ+∆τ)-X(t+τ)|2] =

= 2D[D-k(∆τ)].

Переходя к пределу при ∆τ→0 и принимая во внимание условие теоремы о непрерывности k(τ) в точке τ=0, а также первое равенство системы

K(0) = В = σ2 , найдём

Lim k(τ+∆τ) = k(τ)

Поскольку здесь τ – произвольное число, теорему следует считать доказанной.

Эргодическое свойство стационарных случайных процессов

Пусть Х(t) - стационарный случайный процесс на отрезке времени [0,T] с характеристиками

M[X(t)] = 0, K(t, t’) = M[X(t)X(t’)] = k(τ),

τ = t’ – t, (t, t’) ? T×T.

Эргодическое свойство стационарного случайного процесса заключается в том, что по достаточно длительной реализации процесса можно судить о его математическом ожидании, дисперсии, корреляционной функции.

Более строго стационарный случайный процесс Х(t) будем называть эргодическим по математическому ожиданию, если

Lim M {|(1 / T)∫ X(t)dt|2} = 0

Теорема

Стационарный случайный процесс Х(t) с характеристиками:

M[X(t)] = 0, K(t, t’) = M[X(t)X(t’)] = k(τ),

τ = t’ – t, (t, t’) ? T×T

является эргодическим по математическому ожиданию тогда и только тогда, когда

Lim (2 / T) ∫ k(τ) (1 – τ/t)dτ = 0.

Для доказательства, очевидно, достаточно убедиться, что справедливо равенство

M{(1 / T) ∫X(t)dt|2} = (2 / T) ∫ k(τ) (1 – τ/t)dτ

Запишем очевидные соотношения

C = M {|(1 / T) ) ∫X(t)dt|2} = (1 / T2) ∫ ∫ k(t’ - t)dt’dt = (1/T) ∫ dt ∫ k(t’ - t)dt’.

Полагая здесь τ = t’ – t, dτ = dt’ и учитывая условия (t’ = T) → (τ = T - t),

(t’ = 0)→(τ = -t), получим

С = (1/T2) ∫ dt ∫ k(τ)dτ = (1/T2) ∫ dt ∫ k(τ)dτ + (1/T2) ∫ dt ∫ k(τ)dτ =

= -(1/T2) ∫ dt ∫ k(τ)dτ - (1/T2) ∫ dt ∫ k(τ)dτ

Полагая в первом и втором слагаемых правой части этого равенства соответственно τ = -τ’, dτ = -dτ’, τ = T-τ’, dτ = -dτ’, найдем

С = (1/T2) ∫ dt ∫ k(τ)dτ + (1/T2) ∫ dt ∫ k(T - τ)dτ

Применяя формулу Дирихле для двойных интегралов, запишем

С = (1/T2) ∫ dt ∫ k(τ)dτ + (1/T2) ∫ dt ∫ k(T - τ)dτ = (1/T2) ∫ (T - τ) k(τ)dτ + (1/T2) ∫ τk (T – τ)dτ

Во втором слагаемом правой части можно положить τ’ = T-τ, dτ = -dτ’, после чего будем иметь

С = (1/Т2) ∫ (Т - τ) k(τ)dτ – (1/T2) ∫ (T - τ) k(τ)dτ = 2/T ∫ (1- (τ/T)) k(τ)dτ

Отсюда и из определения констант видно, что равенство

M{(1 / T) ∫X(t)dt|2} = (2 / T) ∫ k(τ) (1 – τ/t)dτ

Справедливо.

Теорема

Если корреляционная функция k(τ) стационарного случайного процесса X(t) удовлетворяет условию

Lim (1/T) ∫ |k(τ)| dt = 0

То X(t) является эргодическим по математическому ожиданию.

Действительно, учитывая соотношение

M{(1 / T) ∫X(t)dt|2} = (2 / T) ∫ k(τ) (1 – τ/t)dτ

Можно записать

0 ≤ (2/Т) ∫ (1 – τ/t) k(τ)dτ ≤ (2/T) ∫ (1- τ/t) |k(τ)|dτ ≤ (1/T) ∫ |k(τ)|dτ

Отсюда видно, что если выполнено условие, то

Lim (2/T) ∫ (1 – τ/T) k(τ)dτ = 0

Теперь, принимая во внимание равенство

С = (1/Т2) ∫ (Т - τ) k(τ)dτ – (1/T2) ∫ (T - τ) k(τ)dτ = 2/T ∫ (1- (τ/T)) k(τ)dτ

И условие Lim M {|(1 / T)∫ X(t)dt|2} = 0

Эргодичности по математическому ожиданию стационарного случайного процесса X(t), находим, что требуемое доказано.

Теорема.

Если корреляционная функция k(τ) стационарного случайного процесса

X(t) интегрируема и неограниченно убывает при τ → ∞, т.е. выполняется условие

При произвольном ε > 0, то X(t) – эргодический по математическому ожиданию стационарный случайный процесс.

Действительно, учитывая выражение

Для Т≥Т0 имеем

(1/T) ∫ |k(τ)|dτ = (1/T)[ ∫ |k(τ)|dτ + ∫ |k(τ)|dτ ≤ (1/T) ∫ |k(τ)|dτ ε(1 – T1/T).

Переходя к пределу при Т → ∞, найдём

0 ≤ lim ∫ |k(τ)|dτ = ε.

Поскольку здесь ε > 0 – произвольная, сколько угодно малая величина, то выполняется условие эргодичности по математическому ожиданию. Поскольку это следует из условия

О неограниченном убывании k(τ), то теорему следует считать доказанной.

Доказанные теоремы устанавливают конструктивные признаки эргодичности стационарных случайных процессов.

Пусть

X(t) = m + X(t), m=const.

Тогда M[X(T)] = m, и если X(t) - эргодический стационарный случайный процесс, то условие эргодичности Lim M {|(1 / T)∫ X(t)dt|2} = 0 после несложных преобразований можно представить в виде

Lim M{[(1/T) ∫ X(t)dt – m]2} = 0

Отсюда следует, что если X(t) – эргодический по математическому ожиданию стационарный случайный процесс, то математическое ожидание процесса X(t) = m + X(t) приближенно может быть вычислено по формуле

M = (1/T) ∫ x(t)dt

Здесь Т – достаточно длительный промежуток времени;

x(t) – реализация процесса X(t) на отрезке времени [0, Т].

Можно рассматривать эргодичность стационарного случайного процесса X(t) по корреляционной функции.

Стационарный случайный процесс X(t) называется эргодическим по корреляционной функции, если

Lim M {[ (1/T) ∫ X(t) X(t + τ)dt – k(τ)]2]} = 0

Отсюда следует, что для эргодического по корреляционной функции стационарного случайного процесса X(t) можно положить

k (τ) = (1/T) ∫ x(t)x(t + τ)dt

при достаточно большом Т.

Оказывается, условие

ограниченности k(τ) достаточно для эргодичности по корреляционной функции стационарного нормально распределенного процесса X(t).

Заметим, случайный процесс называется нормально распределённым, если любая его конечномерная функция распределения является нормальной.

Необходимым и достаточным условием эргодичности стационарного нормально распределенного случайного процесса является соотношение

τ0 : lim (1/T) ∫ [k(τ)2 + k(τ + τ0) k(τ – τ0)] (1 – τ/T)dτ = 0

Литература

1. Н.Ш. Кремер «Теория вероятностей и математическая статистика» / ЮНИТИ / Москва 2007.

2. Ю.В. Кожевников «Теория вероятностей и математическая статистика» /Машиностроение/ Москва 2002.

3. Б.В. Гнеденко «Курс теории вероятностей» /Главная редакция физико-математической литературы/ Москва 1988.

Похожие работы

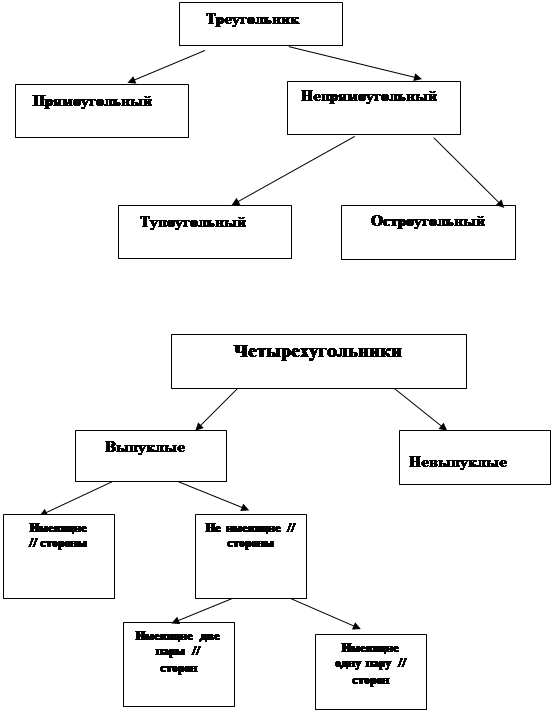

... у младших школьников, обобщен опыт, внесены коррективы. На следующем этапе исследования проводился формирующий эксперимент, цель которого - установить влияние умственного приема классификации на формирование математических понятий у младших школьников. При этом мы исходим из общей рабочей гипотезы исследования, которая заключается в том, что систематическое и целенаправленное формирование и ...

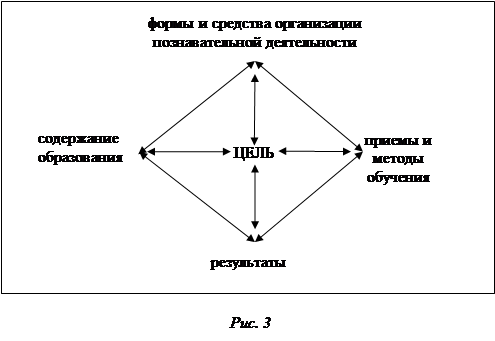

... одна из ее сторон – урок. В работе доказано, что самоанализ урока является основой эффективного управления процессом обучения. Дальнейшей же перспективой исследования является рассмотрение самоанализа всей деятельности учителя как основы управления процессом обучения математике. Изложенное выше позволяет считать, что самоанализ урока математики позволяет управлять процессом обучения школьников и ...

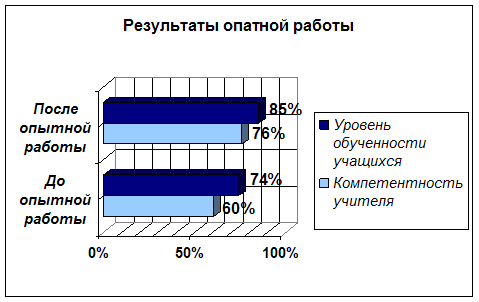

... Однако и в подростковом, и в старшем школьном возрасте имеются еще значительные резервы их совершенствования”.(22,С.108) ГЛАВА 3. Экспериментальная работа по формированию самоконтроля в процессе обучения математике по системе Эльконина- Давыдова. Наша работа посвящена изучению одного из структурных элементов учебной деятельности- изучению самоконтроля младших школьников. Перед началом проведения ...

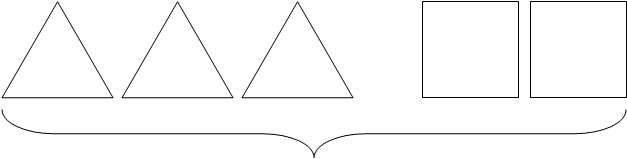

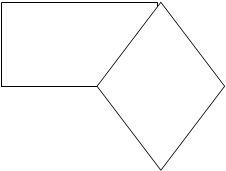

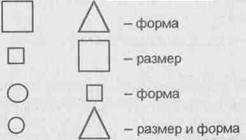

... , в процессе выполнения которых учащиеся будут рассматривать данные в них объекты с различных точек зрения. 3.3. Прием сравнения Особую роль в организации продуктивной деятельности младших школьников в процессе обучения математике играет прием сравнения. Формирование умения пользоваться этим приемом следует осуществлять поэтапно, в тесной связи с изучением конкретного содержания. Целесообразно, ...

0 комментариев