Навигация

Рассмотрим х, у Î [0,1]). Видим, что P(A) = x, P(B) = y, P(A∩B) = x y, так что A = { ξ <1/2} и B= { η <1/2} независимы

1. Рассмотрим х, у Î [0,1]). Видим, что P(A) = x, P(B) = y, P(A∩B) = x y, так что A = { ξ <1/2} и B= { η <1/2} независимы.

2. На рисунке видим, что P(A) = 3/4, P(B) = 3/4 P(A∩B) = 1/2ч≠ (3/4)2, так что события A = { ξ <1/2} и B= { η <1/2} зависимы.

Замечание 8. Если события A и B несовместны, то они независимы, если и только если P(A) = 0 или P(B) = 0

Следствие 2. Если P(B) > 0, то события А и В независимы P(А\В) =Р(А)

Если P(А) > 0, то события А и В независимы P(В\А) =Р(В)

Лемма 1. Если события А и В независимы, то независимы и события ![]() .

.

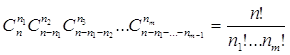

Определение 17. События А1, А2…Аn называются независимыми в совокупности, если для любого набора

1 ≤ i1, i2…ik ≤ n

![]() ) (3)

) (3)

Замечание 9. Если события А1, А2…Аn независимы в совокупности, то они попарно независимы, то есть любые два события Аi, Аj независимы. Достаточно в равенстве (3) взять k =2. Обратное, как показывает следующий пример, неверно.

Пример 15 (Пример С. Н. Бернштейна).

Рассмотрим правильный тетраэдр, 3 грани которого окрашены, соответственно, в красный, синий, зеленый цвета, а четвертая грань содержит все три цвета. Событие A, (B, C) означает, что выпала грань, содержащая красный (синий, зеленый) цвета.

Вероятность каждого из этих событий равна 1/2, так как каждый цвет есть на двух гранях из четырех. Вероятность пересечения любых двух из них равна 1/4, так как только одна грань содержит два цвета. А так как 1/4 = 1/2 1/2, то все события попарно независимы.

Но вероятность пересечения всех трех тоже равна 1/4, а не 1/8, то есть события не являются независимыми в совокупности.

Заметьте, что равенство (6) выполнено для k = 2, но не выполнено для k = 3.

4.3 Формула полной вероятностиПример 16. Есть 3 завода, производящих одну и ту же продукцию. При этом 1-й завод производит 25%, 2-й завод — 35% и 3-й завод — 40% всей производимой продукции. Брак составляет 5% от продукции 1-го завода, 3% от продукции 2-го и 4% от продукции 3-го завода. Вся продукция смешивается и поступает в продажу. Найти а) вероятность купить бракованное изделие; б) условную вероятность того, что купленное изделие изготовлено 1-м заводом, если это изделие бракованное.

Первая вероятность равна доле бракованных изделий в объеме всей продукции, то есть

0,05*0,25 + 0,03*0,35 + 0,04*0,4.

Вторая вероятность равна доле брака 1-го завода среди всего брака, то есть

Определение 18. Набор попарно несовместных событий Н1, Н2… таких, что P(Аi) > 0 для всех i и

![]()

называется полной группой событий или разбиение пространства Ω

События Н1, Н2 …, образующие полную группу событий, часто называют гипотезами. При подходящем выборе гипотез для произвольного события А могут быть сравнительно просто вычислены P(А/ Нi) (вероятность событию А произойти при выполнении «гипотезы» Нi) и собственно P(Нi)(вероятность выполнения «гипотезы» Нi).

Теорема 8 (Формула полной вероятности).

Пусть Н1, Н2 — полная группа событий. Тогда вероятность любого события A может быть вычислена по формуле:

4.4 Формула Байеса

Теорема 9 (Формула Байеса).

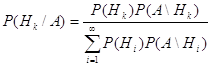

Пусть Н1, Н2 …— полная группа событий и A — некоторое событие положительной вероятности. Тогда условная вероятность того, что имело место событие Нk, если в результате эксперимента наблюдалось событие A, может быть вычислена по формуле:

Пример 17. Вернемся к примеру 15. Изделие выбирается наудачу из всей произведенной продукции. Рассмотрим три гипотезы: Нi = {изделие изготовлено i-м заводом }, i = 1, 2, 3. Вероятности этих событий даны: P(Н1) = 0,25, P(Н2) = 0,35, P(Н3) = 0,4 . Пусть A = {изделие оказалось бракованным }. Даны также условные вероятности P(A\Н1) = 0,05, P(A\Н2) = 0,03, P(A\Н3) = 0,04

Пример 18. Два стрелка подбрасывают монетку и выбирают, кто из них стреляет по мишени (одной пулей). Первый стрелок попадает по мишени с вероятностью 1, второй стрелок — с вероятностью 0,00001. Можно сделать два предположения об эксперименте:

Н1 = {стреляет 1-й стрелок}

Н2 = { стреляет 2-й стрелок } .

Априорные (a’priori —«до опыта») вероятности этих гипотез одинаковы: P(Н1) = P(Н1) = 1/2.

Рассмотрим событие A = {пуля попала в мишень}. Известно, что

P(A\Н1) = 1, P(A\Н2) = 0,00001

Поэтому вероятность пуле попасть в мишень P(A) = 1/2*1 + 1/2*0,00001. . Предположим, что событие A произошло. Какова теперь апостериорная (a’posteriori — «после опыта») вероятность каждой из гипотез Нi? Очевидно, что первая из этих гипотез много вероятнее второй (а именно, в 100000 раз). Действительно, Раздел 5. Схема Бернулли 5.1 Распределение числа успехов в n испытаниях

Определение 19. Схемой Бернулли называется последовательность независимых испытаний, в каждом из которых возможны лишь два исхода — «успех» и «неудача», при этом «успех» в одном испытании происходит с вероятность р Î [0,1], «неудача» — с вероятностью q = 1 - p.

Теорема 10 (Формула Бернулли).

Обозначим через vn число успехов в n испытаниях схемы Бернулли. Тогда для любого k = 0, 1, …n

Доказательство. Событие A ={ vn = k} означает, что в n испытаниях схемы Бернулли произошло ровно k успехов. Рассмотрим один из благоприятствующих событию A элементарных исходов:

Здесь буквами «у» и «н» обозначены, соответственно, успешный и неудачный результаты испытаний. Поскольку испытания независимы, вероятность такого элементарного исхода (первые k испытаний завершились успехом, остальные неудачей) равна pk(1 - p)n-k.

Другие благоприятствующие событию A элементарные исходы отличаются от рассмотренного выше лишь расположением k успехов на n местах. Есть ровно![]() способов расположить k успехов на n местах. Поэтому событие A состоит из

способов расположить k успехов на n местах. Поэтому событие A состоит из ![]() элементарных исходов, вероятность каждого из которых равна pk(1 - p)n-k.

элементарных исходов, вероятность каждого из которых равна pk(1 - p)n-k.

Определение 20. Набор чисел

называется биноминальным распределением вероятностей и обозначается Вnp или B(n,p).

Теорема 11 Пусть m1, m2 целые числа, 0 £ m1 £ m £ m2 £ n Обозначим через Рn(m1,m2) вероятность того, что событие А наступило не менее m1 и не более m2 раз в n испытаниях. Тогда

![]()

По формуле Бернулли, событие «произошло 0 успехов в n испытаниях» имеет вероятность qn , 1 успех — вероятность n p qn и т.д. Какое же число успехов наиболее вероятно? Иначе говоря, при каком k достигается максимум P(vn=k)?

Чтобы выяснить это, сравним отношение P(vn=k)и P(vn=k-1)с единицей.

Видим, что

(a) Р(vn = k) > Р(vn = k-1) при np + p – k > 0, то есть при k < np + p;

(b) Р(vn = k) < Р(vn = k-1 )при np + p – k < 0, то есть при k > np + p;

(c) Р(vn = k) = Р(vn = k-1 при np + p – k = 0, что возможно лишь если np + p — целое число.

Рассмотрим два случая: np + p –целое число и np + p – дробное число. В первом случае пусть k0 = np + p. Из полученных выше неравенств, сразу следует, что

![]()

Во втором случае пусть k0 = [np + p] (целая часть числа np + p, то есть наибольшее целое число, не превосходящее np + p). Из неравенств (a), (b) следует, что

Действительно, неравенство Р(vn = k0) > Р(vn = k0+1), например, следует из (b), примененного для

k = k0+1 > np + p.

Видим, что в зависимости от того, является число 1 > np + p целым или нет, имеется либо два равновероятных «наиболее вероятных» числа успехов k0 = np + p и k0 –1 > np + p - 1,либо одно «наиболее вероятное» число успехов k0 = [np + p].

Сформулируем уже доказанное утверждение в виде теоремы.

Теорема 12. В n испытаниях схемы Бернулли с вероятностью успеха p наиболее вероятным числом успехов является

a) единственное число k0 = [np + p], если число np + p не целое;

б) два числа k0 = np + p и k0 -1= np + p -1, если число np + p целое.

Пример 19. Если p = q = 1/2, то при четном числе испытаний n число np + p = n/2 + 1 /2— не целое, так что наиболее вероятным является единственное число успехов [n/2 + 1 /2] = n/2. Что совершенно понятно, так как есть нечетное число возможностей — получить 0, 1, …n успехов, причем вероятности получить k и n-k успехов одинаковы.

При нечетном же числе испытаний n число np + p = n/2 + 1 /2 — целое, так что наиболее вероятными (и одинаково вероятными) являются два числа успехов n/2 + 1 /2 и n/2 - 1 /2.

5.3 Номер первого успешного испытанияРассмотрим схему Бернулли с вероятностью успеха p в одном испытании. Испытания проводятся до появления первого успеха. Введем величину τ , равную номеру первого успешного испытания.

Теорема 13. Вероятность того, что первый успех произойдет в испытании с номером k, равна

P(τ = k) = p qk-1.

Доказательство. Действительно,

Определение 21. Набор чисел {p qk-1 } называется геометрическим распределением вероятностей и обозначается Gp или G(p).

Геометрическое распределение вероятностей обладает интересным свойством, которое можно назвать свойством «нестарения». Пусть величина τ обозначает, скажем, время безотказной работы (измеряемое целым числом часов) некоторого устройства. Предположим, что для величины τ вероятность принять любое свое значение k в точности равна pqk-1. Справедливо следующее утверждение.

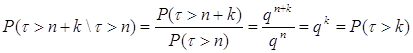

Теорема 14. Пусть P(τ = k) = p qk-1. Тогда для произвольных n, k ³ 0

P(τ > n+k\ τ > n) = P(τ > k)

Данному равенству можно придать следующее звучание: если известно, что устройство проработало без отказов n часов, то вероятность ему работать еще не менее k часов точно такая же, как вероятность проработать не менее k часов для нового устройства.

Можно прочесть эту формулу и так: вероятность работающему устройству проработать еще сколько-то часов не зависит от того момента, когда мы начали отсчет времени, или от того, сколько уже работает устройство.

Доказательство. По определению условной вероятности,

![]() (4)

(4)

Последнее равенство следует из того, что событие {τ > n+k} влечет событие {τ > n}, так что пересечение этих событий есть {τ > n+k}. Найдем для произвольного m ³ 0 вероятность P(τ > m).

![]()

Можно также заметить, что событие {τ > m} означает, что в схеме Бернулли первые m испытаний завершились «неудачами», а это событие имеет вероятность как раз qm.

Возвращаясь к (4), получим

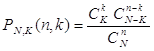

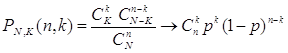

Рассмотрим урну, содержащую N шаров, из которых K шаров — белые, а оставшиеся N-K шаров — черные. Из урны наудачу (без возвращения) выбираются n шаров. Вероятность PN,K(n, k) того, что будет выбрано ровно k белых и n-k черных шаров, находится по формуле (см. определение 8 гипергеометрического распределения вероятностей):

|

Если число шаров в урне очень велико, то извлечение одного, двух, трех шаров почти не меняет пропорцию белых и черных шаров в урне, так что вероятности PN,K(n, k) не очень отличаются от вероятностей в процедуре выбора с возвращением

P(получить ровно k белых шаров при выборе n шаров с возвращением) =

Сформулируем нашу первую предельную теорему.

|

Теорема 15. Если N → ∞ и K → ∞ так, что K/N → p Î (0, 1) то для любых фиксированных n, 0<=k<=n 5.5 Независимые испытания с несколькими исходами

Рассмотрим следующий пример, когда из двух очень похожих вопросов на один можно ответить, пользуясь формулой Бернулли, а для другого этой формулы оказывается недостаточно:

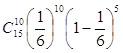

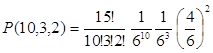

Пример 20. Игральная кость подбрасывается 15 раз. Найти вероятности следующих событий:

а) выпадет ровно 10 шестерок; б) выпадет ровно 10 шестерок и три единицы.

а) есть 15 испытаний схемы Бернулли с вероятностью успеха 1/6 (выпадение шестерки). Вероятность десяти успехов в 15 испытаниях равна

б) здесь каждое испытание имеет три, а не два исхода: выпадение шестерки, выпадение единицы, выпадение остальных граней. Воспользоваться формулой для числа успехов в схеме Бернулли не удается — перед нами уже не схема Бернулли.

Осталось изобрести формулу для подсчета вероятности каждому исходу в нескольких независимых испытаниях выпасть нужное число раз, если в одном испытании возможно не два, а более исходов.

Пусть в одном испытании возможны m исходов. Обозначим их цифрами 1, 2, …m. Пусть исход i в одном испытании случается с вероятностью рi, 1 ≤ i ≤ m и

![]()

Обозначим через Р(n1,n2,…,nm) вероятность того, что в n = n1+ n2+ …+nm независимых испытаний исход 1 появился n1, раз, исход 2 – n2 раз,…

Теорема 16. Для любого n и любых целых n1 ≥ 0… nm ≥ 0 таких, что n1+ n2+ …+nm = n, верна формула:

![]()

Доказательство. Рассмотрим один элементарный исход, благоприятствующий выпадению n1 единиц, n2 двоек, … , nmраз m-ок:

![]()

Это результат n экспериментов, когда все нужные исходы появились в некотором заранее заданном порядке. Вероятность такого результата n независимых испытаний равна

![]()

Все остальные благоприятные исходы отличаются лишь расположением чисел 1, 2, …m на n местах. Число таких исходов равно числу способов расставить на n местах n1 единиц, n2 двоек, , … , nmраз чисел m, то есть

Теперь мы можем вернуться к примеру 20(б) и выписать ответ: так как вероятности выпадения шестерки и единицы равны 1/6, а вероятность третьего исхода (выпали любые другие грани) равна 4/6, то вероятность получить 10 шестерок, 3 единицы и еще 2 других очка равна

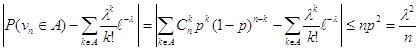

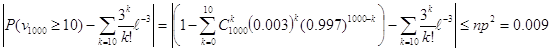

Предположим, нам нужна вероятность получить не менее десяти успехов в 1000 испытаний схемы Бернулли с вероятностью успеха 0.003. Вероятность этого события равна любому из следующих выражений:

![]()

и вычисление даже одного слагаемого в каждом из этих выражений весьма проблематично.

Сформулируем теорему о приближенном вычислении вероятности какого-либо числа успехов в большом числе испытаний схемы Бернулли с маленькой вероятностью успеха. Термин «большое число» должен означать n → ∞. Если при этом p = pn→ 0,то, очевидно, вероятность получить любое конечное число успехов при растущем числе испытаний стремится к нулю. Необходимо чтобы вероятность успеха p = pn→ 0 одновременно с ростом числа испытаний. Но от испытания к испытанию вероятность успеха меняться не может (см. определение схемы Бернулли).

Поэтому рассмотрим «схему серий»: есть

одно испытание ○ с вероятностью успеха p1

два испытания ○ , ○ с вероятностью успеха p2

…

n испытаний ○ , … , ○ с вероятностью успеха pn

…

Вероятность успеха меняется не внутри одной серии испытаний, а от серии к серии, когда меняется общее число испытаний. Обозначим через vn число успехов в n-той серии испытаний.

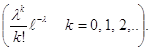

Теорема 17 (Теорема Пуассона).

Пусть n → ∞ , pn→ 0 так, что n pn→ λ > 0. Тогда для любого k ≥ 0 вероятность получить k успехов в n испытаниях схемы Бернулли с вероятностью успеха pn стремится к величине

![]() (5)

(5)

![]() для n → ∞ , pn→ 0 так, что n pn→ λ

для n → ∞ , pn→ 0 так, что n pn→ λ

Определение 22. Пусть λ > 0— некоторая постоянная. Набор чисел  называется распределением Пуассона с параметром λ.

называется распределением Пуассона с параметром λ.

Пользуясь теоремой 17, можно приближенно посчитать вероятность получить не менее десяти успехов в 1000 испытаний схемы Бернулли с вероятностью успеха 0.003, с вычисления которой мы начали. Поскольку n = 1000 «велико», а pn = 0.003 «мало», то, взяв λ = n pn= 3 , можно написать приближенное равенство

![]() (6)

(6)

Осталось решить, а достаточно ли n=103 «велико», а pn = 0.003 «мало», чтобы заменить точную вероятность P(vn = k) на приближенное значение

![]()

Для этого нужно уметь оценивать разницу между этими двумя вероятностями.

Теорема 18 (Теорема Пуассона с оценкой погрешности).

Пусть A Í {0, 1, …, n} — произвольное множество целых неотрицательных чисел, vn — число успехов в n испытаниях схемы Бернулли с вероятностью успеха p, λ = n p. Тогда

Таким образом, теорема 18 предоставляет нам возможность самим решать, достаточно ли n «велико», а p «мало», руководствуясь полученной величиной погрешности.

Какова же погрешность в формуле (6)?

Погрешность не более 0,009 (при вероятности около 0,001). Во всяком случае, можно утверждать, что искомая вероятность никак не больше, чем 0,01=0,001+0,009.

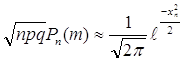

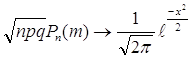

Рассмотрим еще одну формулу приближенного вычисления pn (m) когда n велико. В отличии от предыдущего результата число успехов m в этом случае тоже растет с ростом n, а вероятность успеха постоянна.

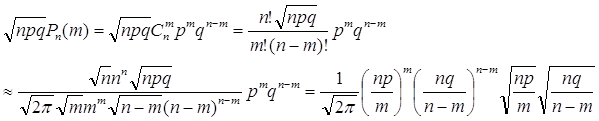

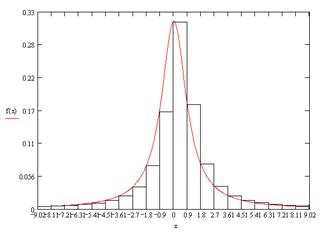

Локальная теорема Муавра – Лапласа

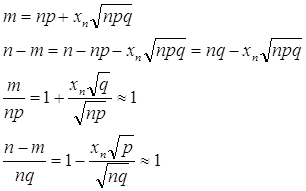

Пусть ![]() .Предположим, что

.Предположим, что ![]() и величины

и величины ![]() являются ограниченными. Тогда

являются ограниченными. Тогда

В частности, если ![]() , то

, то

Доказательство:

В силу ограниченности величин ![]() разность

разность ![]() вместе с n и m Воспользуемся формулой Стирлинга

вместе с n и m Воспользуемся формулой Стирлинга

![]()

В силу определения ![]()

Мы уже видели, что для очень многих экспериментов нет никаких различий в подсчете вероятностей событий, тогда как элементарные исходы в этих экспериментах очень различаются. Но нас и должны интересовать именно вероятности событий, а не структура пространства элементарных исходов. Поэтому пора во всех таких «похожих» экспериментах вместо самых разных элементарных исходов использовать, например, числа. То есть ввести соответствие (иначе говоря, отображение) между элементарными исходами и вещественными числами (с ними удобно работать).

Пусть имеется случайный эксперимент и задано вероятностное пространство (Ω, Ψ,Р).

Определение 23. Функция ξ: Ω →R называется случайной величиной, если для любого х Î R множество { ξ < x} = {ω: ξ(ω) < x} является событием, то есть принадлежит σ-алгебре событий Ψ.

Замечание 10. Можно смело считать, что любое множество элементарных исходов есть событие, и, следовательно, случайная величина есть произвольная функция из Ω в R. Никаких неприятностей на практике это обычно не влечет.

Определение 24. Будем говорить, что функция ξ: Ω →R является Ψ -измеримой, если {ω: ξ(ω) < x} принадлежит Ψ для любого х Î R.

Итак, случайная величина есть Ψ - измеримая функция, ставящая в соответствие каждому элементарному исходу ω Î Ω число ξ(ω) Î R.

Пример 21. Подбрасываем 1 раз кубик. Пусть Ω = {1, 2, 3, 4, 5, 6} , и две функции из Ω в заданы так: ξ(ω)= ω , η(ω)= ω2.

Если Ψ есть множество всех подмножеств Ω, то ξ и η являются случайными величинами, поскольку любое множество элементарных исходов принадлежит Ψ, в том числе и {ω: ξ(ω) < x} или {ω: η (ω) < x} . Можно записать соответствие между значениями случайных величин ξ и η вероятностями принимать эти значения в виде «таблицы распределения вероятностей» или, коротко, «таблицы распределения»:

| ξ | 1 | 2 | 3 | 4 | 5 | 6 |

| Р | 1/6 | 1/6 | 1/6 | 1/6 | 1/6 | 1/6 |

| η | 1 | 4 | 9 | 16 | 25 | 36 |

| Р | 1/6 | 1/6 | 1/6 | 1/6 | 1/6 | 1/6 |

Здесь 1/6 = Р(ξ=1)=…= Р(ξ=6) = Р(η =1)= …= Р(η =36)

Пусть σ -алгебра событий Ψ состоит всего из четырех множеств:

Ψ = { Ω ,Æ, {1,3,5},{2,4,6} }

то есть событием является, кроме достоверного и невозможного событий, выпадение четного (соответственно, нечетного) числа очков. Убедимся, что при такой «бедной» σ -алгебре ни ξ, ни η не являются случайными величинами, так как эти функции не Ψ - измеримы. Возьмем (например) x = 3,967. Видим, что

{ω Î Ω: ξ(ω) < 3,967}= {1, 2, 3}Ï Ψ и {ω Î Ω: η (ω) < 3,967}= {1}Ï Ψ

Теперь попробуем понять, зачем нужна Ψ - измеримость и почему требуется, чтобы {ω: ξ(ω) < x} являлось событием.

Если задана случайная величина ξ, нам может потребоваться вычислить вероятности типа

P(ξ = 5) = P{ω: ξ(ω) = 5},

P (ξ Î [-3,7]),

P(ξ ³ 3,2),

P(ξ > 0)

(и вообще самые разные вероятности попадания в различные множества на прямой). Это возможно только если множества, стоящие под знаком вероятности, являются событиями (напомню, что вероятность есть функция из σ - алгебры событий в [0,1]).

Но если потребовать, чтобы Ax = {ω: ξ(ω) < x} было событием при любом x, то мы из свойств σ - алгебры сразу получим, что

и ![]() — событие, и

— событие, и ![]() — событие,

— событие,

и ![]() — событие,

— событие,

и {ω: ξ(ω) = x}= Bx \ Ax — событие, (7)

и т.д., и т.п. (операции пересечения, объединения, дополнения событий не выводят из класса событий).

Можно потребовать в определении 23 чего-нибудь другого. Например, чтобы событием было попадание в любой интервал: (ω: ξ(ω) Î [a, b]) для любых a < b.

Или чтобы {ω: ξ(ω) ³ x} было событием для любого x. Любое такое определение эквивалентно исходному.

Опишем различные типы распределений случайных величин. Под распределением случайной величины мы будем понимать соответствие

«значение случайной величины ↔ вероятность принимать это значение»,

либо (чаще)

«множество на прямой ↔ вероятность случайной величине попасть в это множество».

6.2 Дискретные распределенияОпределение 25. Говорят, что случайная величина ξ имеет дискретное распределение, если существует конечный или счетный набор чисел {a1, a2, …} такой, что:

а) pi = P{ ξ = ai} > 0 для всех i;

б)![]() .

.

То есть случайная величина ξ имеет дискретное распределение, если она принимает не более чем счетное число значений.

Определение 26. Если случайная величина ξ имеет дискретное распределение, назовем таблицей распределения соответствие ai ↔ pi, которое чаще всего рисуют так:

| ξ | а1 | а2 | а3 | … |

| Р | р1 | р2 | р3 | … |

Говорят, что случайная величина ξ имеет вырожденное распределение с параметром а, и пишут ξ Î Ia если ξ принимает единственное значение а с вероятностью 1, то есть P(ξ = a) = 1. Таблица распределения ξ имеет вид

| ξ | а |

| Р | 1 |

Говорят, что случайная величина ξ имеет распределение Бернулли с параметром р, и пишут ξ Î Вр, если ξ принимает значения 1 и 0 с вероятностями р и 1 - р, соответственно. Случайная величина ξ с таким распределением равна числу успехов в одном испытании схемы Бернулли с вероятностью успеха (0 успехов или 1 успех). Таблица распределения ξ имеет вид

| ξ | 0 | 1 |

| Р | (1-p) | р |

Говорят, что случайная величина ξ имеет биномиальное распределение с параметрами n и p, где 0 £ p £, n и пишут ξ Î Вn,р, если ξ принимает значения 0, 1, …,n с вероятностями P(ξ = k) = Cnk pk (1-p)n-k . Случайная величина ξ с таким распределением имеет смысл числа успехов в n испытаниях схемы Бернулли с вероятностью успеха р .

Таблица распределения ξ имеет вид

| ξ | 0 | 1 | … | k | … | n |

| Р | (1-p)n | n p(1-p)n-1 | … | Cnk pk (1-p)n-k | … | Pn |

Говорят, что случайная величина τ имеет геометрическое распределение с параметром р, где 0 £ p £, n, и пишут τ Î Gр, если τ принимает значения 1, 2, 3, …с вероятностями P(τ = k) = p (1-p)k-1. Случайная величина τ с таким распределением имеет смысл номера первого успешного испытания в схеме Бернулли с вероятностью успеха р .

Таблица распределения τ имеет вид

| τ | 1 | 2 | … | k | … |

| Р | p | Р (1 – р) | … | p (1-p)k-1 | … |

Говорят, что случайная величина ξ имеет распределение Пуассона с параметром λ, где λ > 0 , и ξ Î П λ, если ξ принимает значения 0, 1, 2 … с вероятностями

![]()

Таблица распределения ξ имеет вид

| ξ | 1 | 2 | … | k | … |

| Р | е- λ | λ е- λ | … | (λk /k!)е- λ | … |

Говорят, что случайная величина ξ имеет гипергеометрическое распределение с параметрами n, N и K, K £ N, n £ N если ξ принимает целые значения от max (0, N - K – n ) до min (K ,n ) с вероятностями

![]()

. Случайная величина ξ с таким распределением имеет смысл числа белых шаров среди n шаров выбранных наудачу и без возвращения из урны, содержащей К белых шаров и N-K не белых.

Заметьте, что со всеми этими распределениями мы уже хорошо знакомы.

Но распределения случайных величин далеко не исчерпываются дискретными распределениями. Так, например, если точка бросается наудачу на отрезок [0,1], то можно задать случайную величину, равную координате этой точки. Но число значений этой случайной величины несчетно, так что ее распределение дискретным не является. Да и вероятность этой случайной величине принять каждое из своих возможных значений (попасть в точку) равна нулю. Так что не только таблица распределения не существует, но и соответствие «значение величины « вероятность его принять» ничего не говорит о распределении случайной величины.

Какими же характеристиками еще можно описать распределение?

Раздел 7. Функция распределенияЗаметим, что на том же отрезке [0, 1] вероятности попадания в множества положительной меры совсем не нулевые. И термин «наудачу» мы когда-то описывали как раз в терминах вероятностей попадания в множество. Может быть, разумно описать распределение случайной величины, задав для любого множества, вероятность принять значения из этого множества? Это действительно полное описание распределения, но уж очень трудно с ней работать — слишком много множеств на прямой.

Нельзя ли обойтись заданием вероятностей попадания в какой-нибудь меньший набор множеств на прямой? Оказывается, что можно ограничиться только вероятностями попадания в интервалы (-¥, х) для всех х Î R, с помощью которых можно будет определить и вероятность попасть в любое другое множество.

Замечание 11. Можно с таким же успехом ограничиться набором вероятностей попадания в интервалы (-¥, х], или в (х ,¥), или в [х ,¥), или в (х1 ,x2). Впрочем, последних уже слишком много.

Определение 27.Функцией распределения случайной величины ξ называется функция Fξ(x) : R ® [0, 1], при каждом x Î R равная Fξ(x) = P(ξ < x) = P{ω: ξ(ω) < x}

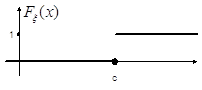

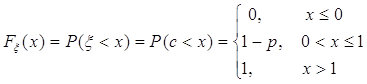

Пример 22. Случайная величина ξ имеет вырожденное распределение Ic. Тогда

![]()

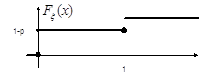

Пример 23. Случайная величина ξ имеет распределение Бернулли Вр. Тогда

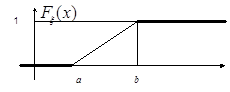

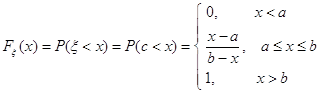

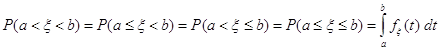

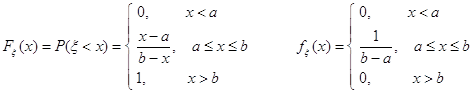

Пример 24. Будем говорить, что случайная величина ξ имеет равномерное распределение на отрезке [a, b] и писать ξ Î Ua,b (“ uniform”), если ξ — координата точки, брошенной наудачу на отрезок [a, b] числовой прямой. Это распределение можно задать и с помощью функции распределения:

Теорема 19.

Функция распределения Fξ(x) обладает следующими свойствами:

F1) Функция распределения Fξ(x) не убывает: если х1 < x2 то Fξ(x1)< Fξ(x2);

F2) Существуют пределы

![]() и

и ![]()

F3) Функция распределения Fξ(x) непрерывна слева:

![]()

Теорема 20. Если функция F: R ® [0, 1] удовлетворяет свойствам (F1)–(F3), то F есть функция распределения некоторой случайной величины ξ, то есть найдется вероятностное пространство (Ω, Ψ, Р) и случайная величина ξ на этом пространстве, что F(х) = Fξ(x).

Прочие полезные свойства функций распределенияF4) В любой точке х0 разница Fξ(х0+0) - Fξ(х0) равна P(ξ = х0):

Следствие 3. Если функция распределения Fξ(x) непрерывна в точке х0, то

P(ξ = х0) = 0F5) Для любой случайной величины ξ имеет место равенство P(а £ ξ < b) = Fξ(a) - Fξ(b).

Если же функция распределения Fξ(x) непрерывна (для любого x, или только в точках a и b), то

P(а £ ξ < b) = P(а < ξ < b) = P(а £ ξ £ b) = P(а < ξ £ b) = Fξ(a) - Fξ(b)

Функция распределения дискретного распределенияМы уже видели, как выглядят функции распределения некоторых дискретных распределений. Из свойств (F4), (F5) следует

Свойство 4. Случайная величина ξ имеет дискретное распределение тогда и только тогда, когда функция распределения Fξ — ступенчатая функция. При этом возможные значения ξ — точки ai скачков Fξ, и

pi = P(ξ = ai ) = Fξ (ai + 0) - Fξ (ai )— величины скачков.

В следующей главе мы рассмотрим случайные величины, функции распределения которых не удовлетворяют свойству 4 хотя бы потому, что они вовсе не имеют разрывов. Более того, мы выделим класс функций распределения, которые «восстанавливаются по своей производной» с помощью интегрирования (так называемые абсолютно непрерывные функции).

Раздел 8. Абсолютно непрерывные распределенияОпределение 28.Случайная величина ξ имеет называемые абсолютно непрерывное распределение, если существует неотрицательная функция fξ(x) такая, что для любого х Î R функция распределения Fξ(x) представима в виде

![]()

При этом функция fξ(x) называется плотностью распределения случайной величины ξ.

Теорема 21.Плотность распределения обладает свойствами:

(f1) fξ(x)³ 0 для любого x;

(f2) ![]()

Эти два свойства полностью характеризуют класс плотностей:

Лемма 2. Если функция f обладает свойствами (f1) и (f2), то существует вероятностное пространство и случайная величина ξ на нем, для которой f является плотностью распределения.

Доказательство. Пусть Ω есть область, заключенная между осью абсцисс и графиком функции f (« подграфик» функции f). Площадь области Ω равна 1 по свойству (f2). И пусть случайная величина ξ есть абсцисса точки, наудачу брошенной в эту область.

Тогда (вспомнить геометрическую вероятность) для любого х Î R

![]()

|

то есть f является плотностью распределения случайной величины ξ Свойства плотностей

(f3) Если случайная величина ξ имеет абсолютно непрерывное распределение, то ее функция распределения всюду непрерывна.

Следствие 4. Если случайная величина ξ имеет абсолютно непрерывное распределение, то P(ξ = х) = 0 для любого х Î R.

(f4) Если случайная величина ξ имеет абсолютно непрерывное распределение, то ее функция распределения дифференцируема почти всюду, и

![]()

для почти всех х.

Замечание 12. Термин для «почти всех» означает «для всех, кроме (возможно) х из некоторого множества нулевой меры (длины)». Заметьте, что стоящую под интегралом функцию можно изменить в одной точке (или на множестве нулевой длины), и интеграл (« площадь подграфика») от этого не изменится.

(f5) Если случайная величина ξ имеет абсолютно непрерывное распределение, то

Доказательство. Действительно,

![]()

Остальные равенства вытекают из следствия 5.

8.1 Примеры абсолютно непрерывных распределенийРавномерное.

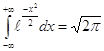

Это распределение нам уже знакомо. Говорят, что ξ имеет равномерное распределение на отрезке [a, b], и пишут ξ Î Ua,b если

Заметьте, что в точках a и b функция распределения недифференцируема, и плотность можно задать как угодно.

Показательное.

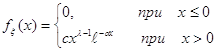

Говорят, что ξ имеет показательное распределение с параметром α, α > 0 и ξ Î Еα, если

Показательное распределение является единственным абсолютно непрерывным распределением, для которого выполнено свойство «не старения» (и в этом смысле оно является непрерывным аналогом дискретного геометрического распределения).

Теорема 21. Свойство «Не старения». Пусть ξ Î Еα. Тогда для любых х, у > 0

![]()

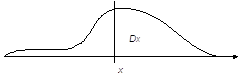

Нормальное.

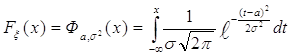

![]() Говорят, что ξ имеет нормальное распределение с параметрами а и σ2 , где а Î R, σ > 0, и пишут ξ Î если ξ имеет следующую плотность распределения:

Говорят, что ξ имеет нормальное распределение с параметрами а и σ2 , где а Î R, σ > 0, и пишут ξ Î если ξ имеет следующую плотность распределения:

![]() для любого x Î R

для любого x Î R

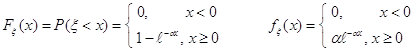

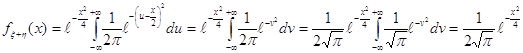

Убедимся, что fξ(x)действительно является плотностью распределения. Так как fξ(x) > 0 для всех x Î R, то свойство (f1) выполнено. Проверим выполнение (f2). Используем табличный интеграл (интеграл Пуассона)

Нормальное (иначе называемое гауссовским по имени Карла Гаусса распределение играет исключительно важную роль в теории вероятностей, поэтому мы очень подробно изучим все свойства этого распределения.

8.2 Свойства нормального распределенияНормальное распределение задается, как мы видим, с помощью плотности распределения. Связано это с тем, что нельзя выписать первообразную от функции![]() иначе как в виде интеграла, поэтому функцию распределения этого закона можно записать лишь в таком виде:

иначе как в виде интеграла, поэтому функцию распределения этого закона можно записать лишь в таком виде:

![]() Мы часто будем использовать обозначение для функции распределения нормального распределения с параметрами а и σ2.

Мы часто будем использовать обозначение для функции распределения нормального распределения с параметрами а и σ2.

Нормальное распределение при ![]() а = 0 и σ= 1 называется стандартным нормальным распределением. Плотность стандартного нормального распределения имеет вид

а = 0 и σ= 1 называется стандартным нормальным распределением. Плотность стандартного нормального распределения имеет вид

![]() для любого x Î R

для любого x Î R

а функция распределения

![]()

табулирована (то есть ее значения вычислены при многих х) почти во всех математических справочниках. Установим связь между

![]()

Свойство 5. Для любого x Î R справедливо соотношение

![]()

То же самое на языке случайных величин можно сформулировать так:

![]() Следствие 5. Если

Следствие 5. Если ![]() то

то

Следствие 6. Если ![]() то

то

![]()

Как мы видим, вычисление любых вероятностей для нормально распределенной случайной величины сводится к вычислению функции распределения Ф0,1. Ее свойства

Свойство 6. Ф0,1(0) = 0,5

Свойство 7. Ф0,1(-х) = 1 - Ф0,1(х)

Свойство 8. Если ξ Î N0,1, то

![]()

Свойство 9 (« Правило трех сигм»).

Если ![]() то

то![]()

Смысла в запоминании числа 0.0027 нет никакого, а вот помнить, что почти вся масса нормального распределения сосредоточена в границах [a - 3σ, a - 3σ] всегда полезно.

Смысла в запоминании числа 0.0027 нет никакого, а вот помнить, что почти вся масса нормального распределения сосредоточена в границах [a-3σ, a+3σ], всегда полезно.

Раздел 9. Случайные вектора и их распределенияОпределение 29. Если случайные величины ![]() заданы на одном вероятностном пространстве, то вектор (

заданы на одном вероятностном пространстве, то вектор (![]() ) мы будем называть случайным вектором.

) мы будем называть случайным вектором.

Определение 30. Функция ![]() называется функцией распределения случайного вектора (

называется функцией распределения случайного вектора (![]() ) или функцией совместного распределения случайных величин

) или функцией совместного распределения случайных величин ![]() .

.

Для простоты обозначений все дальнейшие рассуждения и формулировки приводятся в случае n = 2 для случайного вектора (![]() )

)

F0) ![]()

F1) ![]() не убывает по каждой координате вектора (x1 x2).

не убывает по каждой координате вектора (x1 x2).

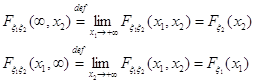

F2) Для любого i = 1, 2, существуют

![]()

![]()

При этом

F3) Функция ![]() по каждой координате вектора (x1 x2) непрерывна слева.

по каждой координате вектора (x1 x2) непрерывна слева.

Только теперь этих свойств оказывается недостаточно для описания класса функций совместного распределения. Иначе говоря, выполнение этих свойств для некоторой функции F: R2 ® R вовсе не гарантирует, что эта функция является функцией распределения некоторого случайного вектора.

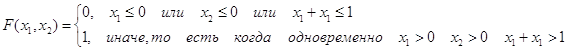

Пример 25. Функция

![]()

a) удовлетворяет всем свойствам (F0)-(F3);

б) не является функцией распределения никакого вектора (ξ1, ξ2.) хотя бы потому, что, найдись такой вектор, найдется и прямоугольник [a1 b1] x [a2 b2], вероятность попасть в который (вычисленная с помощью этой «функции распределения») отрицательна:

P(a1 £ ξ1< b1 , a2 £ ξ2<b2 ) < 0!

Как же связана вероятность вектору попасть в прямоугольник с функцией распределения этого вектора?

Упражнение. Доказать, что

P(a1 £ ξ1< b1 , a2 £ ξ2<b2 )= F ξ1 ξ2 (b1, b2) - F ξ1 ξ2 (a1, b2) - F ξ1 ξ2 (b1, a2) + F ξ1 ξ2 (a1, a2) (8)

Оказывается, если потребовать дополнительно от функции F, чтобы для всякого [a1 b1] x [a2 b2] вероятность P(a1 £ ξ1< b1] , [a2 £ ξ2<b2], связанная с функцией F равенством (8), была неотрицательна, то любая функция, обладающая этим свойством и свойствами (F0)-(F3), уже будет функцией распределения некоторого случайного вектора.

9.2 Типы многомерных распределенийОграничимся рассмотрением только двух случаев, когда совместное распределение координат случайного вектора (ξ1, ξ2.) либо дискретно, либо абсолютно непрерывно.

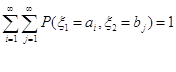

Дискретное совместное распределениеОпределение 31. Говорят, что случайные величины ξ1, ξ2. имеют дискретное, совместное распределение, если существует конечный или счетный набор { ai, bi } такой, что

Таблицу, на пересечении i-й строки и j-го столбца которой (или наоборот) стоит число

P(ξ1= ai ,ξ2= bj) называют таблицей совместного распределения случайных величин ξ1,. ξ2

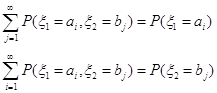

Замечание 13. Напомню, что таблицы распределения каждой из случайных величин ξ1, ξ2 в отдельности (таблицы частных, или маргинальных распределений) восстанавливаются по таблице совместного распределения с помощью очевидных формул:

Если эти формулы вам не представляются очевидными, необходимо вернуться к разделу 4 и перечитать определение 18 полной группы событий, обратив также внимание на доказательство теоремы 8 (формулы полной вероятности).

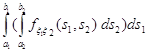

Абсолютно непрерывное совместное распределениеОпределение 32. Говорят, что с.в. ξ1, ξ2 (заданные на одном вероятностном пространстве) имеют абсолютно непрерывное совместное распределение, если существует функция ![]() такая, что для любой точки (x1, x2) Î R2

такая, что для любой точки (x1, x2) Î R2

![]()

Если такая функция ![]() существует, она называется плотностью совместного распределения случайных величин ξ1, ξ2.

существует, она называется плотностью совместного распределения случайных величин ξ1, ξ2.

Замечание 14. Для всего дальнейшего более чем достаточно считать, что

равняется объему под графиком функции f над областью интегрирования — прямоугольником [a1,b1] x [a2,b2].

Плотность совместного распределения обладает свойствами, аналогичными свойствам плотности распределения одной случайной величины:

(f1) ![]() для любых x1, x2 Î R;

для любых x1, x2 Î R;

(f2) ![]() .

.

Более того, любая функция, обладающая этими свойствами, является плотностью некоторого совместного распределения.

Если совместное распределение абсолютно непрерывно, то по функции совместного распределения его плотность находится как смешанная частная производная:

(f3) ![]() .

.

Из свойства (F2) функции совместного распределения вытекает следующее утверждение. Для n > 2 это утверждение, как и свойство (F2), выглядит существенно иначе!

Теорема 22. Если случайные величины ξ1, ξ2 имеют абсолютно непрерывное совместное распределение с плотностью f (x1, x2), то ξ1, и ξ2 в отдельности также имеют абсолютно непрерывное распределение с плотностями:

![]()

Определение 33. Случайные величины ξ1, ξ2, … , ξn независимы, если для любого набора множеств В1 Í R, … Вn Í R имеет место равенство:

![]()

Это определение можно сформулировать в терминах функций распределения:

Определение 34. Случайные величины ξ1, ξ2, … , ξn независимы, если для любых х1, х2, … , хn имеет место равенство:

![]()

Определение 35. Случайные величины ξ1, ξ2, … , ξn с дискретным распределением независимы, если для любых а1, а2, … , аn имеет место равенство:

![]()

Для случайных величин с абсолютно непрерывным совместным распределением определение независимости можно сформулировать так:

Определение 36. Случайные величины ξ1, ξ2, … , ξn с абсолютно непрерывным совместным распределением независимы, если плотность совместного распределения равна произведению плотностей случайных ξ1, ξ2, … , ξn, то есть для любых х1, х2, … , хn имеет место равенство:

![]()

Мы будем рассматривать только преобразования случайных величин с абсолютно непрерывными распределениями. Пусть с. в. ξ имеет функцию распределения Fξ(x) и плотность распределения fξ(x). Построим с помощью функции g: R® R случайную величину η= g(ξ). Требуется найти функцию распределения и, если существует, плотность распределения η.

Замечание 15. Плотность распределения случайной величины η= g(ξ) существует далеко не при любых функциях g. Так, если функция g кусочно-постоянна, то с. в. η имеет дискретное распределение, и плотность ее распределения не существует.

Плотность распределения g(ξ) заведомо существует, если, например, функция g(ξ) монотонна («строго монотонна»). Вспомним, что означает «найти плотность распределения η, если она существует».

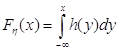

По определению, если мы представим (для любого х) функцию распределения η в виде где подинтегральная функция h(y) неотрицательна, то плотность распределения с.в. η существует и в точности равна подинтегральной функции fξ(x) = h(x) .

где подинтегральная функция h(y) неотрицательна, то плотность распределения с.в. η существует и в точности равна подинтегральной функции fξ(x) = h(x) .

Так что доказывать существование плотности распределения и находить ее мы будем одновременно, находя нужное интегральное представление для функции распределения.

Теорема 23. Пусть ξ имеет функцию распределения Fξ(x) и плотность распределения fξ(x) , и постоянная a отлична от нуля. Тогда случайная величина η = a ξ + b имеет плотность распределения

![]()

Для произвольной монотонной функции g (то есть либо монотонно возрастающей функции, либо монотонно убывающей функции справедливо аналогичное теореме 23 утверждение).

Теорема 24. Пусть ξ имеет функцию распределения Fξ(x) и плотность распределения fξ(x), и функция g: R® R монотонна. Тогда случайная величина η= g(ξ) имеет плотность распределения

![]()

Здесь g -1— функция, обратная к g, и

![]() — производная функции g -1.

— производная функции g -1.

Следствие 7. Если ξ Î N0,1, то η = σξ+а Î ![]()

Следствие 8. Если η Î ![]() , то ξ = (η –а)/ σ Î N0,1.

, то ξ = (η –а)/ σ Î N0,1.

Следствие 9. Если ξ Î Еα, то η = αξÎ Е1

10.2 Функции от двух случайных величинПусть ξ1 ξ2 — случайные величины с плотностью совместного распределения ![]() , и задана функция g : R2® R. Требуется найти функцию (а если существует, то и плотность) распределения случайной величины η = g(ξ1 , ξ2).

, и задана функция g : R2® R. Требуется найти функцию (а если существует, то и плотность) распределения случайной величины η = g(ξ1 , ξ2).

Пользуясь тем, что вероятность случайному вектору попасть в область можно вычислить как объем под графиком плотности распределения вектора над этой областью, сформулируем утверждение.

Теорема 25. Пусть хÎ R, и область Dx Î R2 состоит из точек (x1 x2 ) таких, что g (x1 x2 ) < x. Тогда случайная величина η = g(ξ1 , ξ2). имеет функцию распределения

![]()

Всюду далее в этой главе предполагается, что случайные величины ξ1 и ξ2 независимы, то есть ![]()

Следствие 10 (Формула свертки). Если с. в. ξ1 и ξ2 независимы и имеют абсолютно непрерывное распределение с плотностями f ξ1(x1) и f ξ2(x2)., то плотность распределения суммы ξ1 + ξ2 равна «свертке» плотностей f ξ1(x1) и f ξ2(x2)

![]() (9)

(9)

Следствие 10 не только предлагает формулу для вычисления плотности распределения суммы, но и утверждает (заметьте!), что сумма двух независимых случайных величин с абсолютно непрерывными распределениями также имеет абсолютно непрерывное распределение.

Если даже одна из двух независимых случайных величин имеет дискретное, а вторая – абсолютно непрерывное распределение, то их сумма тоже имеет абсолютно непрерывное распределение, как показывает следующее упражнение.

Упражнение. Пусть с. в. ξ имеет таблицу распределения P(ξ = аi) = pi, с. в. η имеет плотность распределения fη(x), и эти величины независимы. Доказать, что ξ +η имеет плотность распределения

![]()

![]()

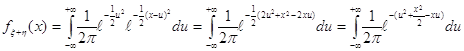

Пример 26. Пусть независимые случайные величины ξ и η имеют стандартное нормальное распределение. Докажем, что их сумма имеет нормальное распределение с параметрами 0 и 2.

Доказательство. По формуле свертки, плотность суммы равна

Выделим полный квадрат по u в показателе экспоненты:

![]()

Тогда

Последнее равенство верно поскольку под интегралом стоит плотность нормального распределения с параметрами 0 и ![]() , так что интеграл по всей прямой равен 1. Итак, мы получили, что плотность суммы есть плотность нормального распределения с параметрами 0 и 2.

, так что интеграл по всей прямой равен 1. Итак, мы получили, что плотность суммы есть плотность нормального распределения с параметрами 0 и 2.

Если сумма двух независимых случайных величин из одного и того же распределения (возможно, с разными параметрами) имеет такое же распределение, говорят, что это распределение устойчиво относительно суммирования.

В следующих утверждениях, перечислены практически все устойчивые распределения.

Лемма 3. Пусть случайные величины ξ Î Пλ и ηÎ Пμ независимы. Тогда ξ+ η Î Пλ+μ

Лемма 4. Пусть случайные величины ξ Î Bn,p и ξ Î Bm,p независимы. Тогда ξ+ η Î Bm+n,p

Лемма 5. Пусть случайные величины ![]() и

и ![]() независимы. Тогда

независимы. Тогда ![]()

Показательное распределение не устойчиво по суммированию, однако его можно считать частным случаем гамма-распределения, которое уже в некотором смысле устойчиво относительно суммирования.

Определение 37. Случайная величина ξ имеет гамма-распределение Гα,λс параметрами α > 0, λ > 0, если она имеет плотность распределения

где постоянная c вычисляется из условия

![]()

Заметим, что показательное распределение Еα есть гамма-распределение Гα,1.

Лемма 6. Пусть независимые случайные величины ξ1, … , ξn имеют показательное распределение Еα = Гα,1 Тогда ξ1 +…+ξn Î Гα,n

«Случайных величин без мат. ожидания не бывает, так как, если у нас есть случайная величина мы всегда в праве от нее что-нибудь ожидать.»

Из студенческой контрольной работы.

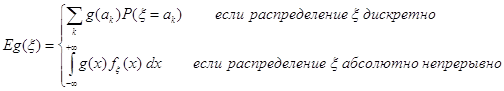

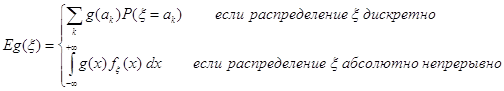

Раздел 11. Числовые характеристики случайных величин 11.1 Математическое ожидание случайной величиныОпределение 38. Математическим ожиданием Eξ (средним значением, первым моментом) случайной величины ξ с дискретным распределением, задаваемым таблицей P(ξ = аi) = pi, называется число

![]() если указанный ряд абсолютно сходится.

если указанный ряд абсолютно сходится.

Если же

![]() , то говорят, что математическое ожидание не существует.

, то говорят, что математическое ожидание не существует.

Определение 39. Математическим ожиданием Eξ случайной величины ξ с абсолютно непрерывным распределением с плотностью распределения fξ(x), называется число

![]() если указанный интеграл абсолютно сходится.

если указанный интеграл абсолютно сходится.

Если же

![]() , то говорят, что математическое ожидание не существует.

, то говорят, что математическое ожидание не существует.

Математическое ожидание имеет простой физический смысл: если на прямой разместить единичную массу, поместив в точку аi массу pi (для дискретного распределения), или «размазав» ее с плотностью fξ(x) (для абсолютно непрерывного распределения), то точка Eξ есть координата «центра тяжести» прямой.

Пример 26. Пусть случайная величина ξ равна числу очков, выпадающих при одном подбрасывании кубика. Тогда

![]()

![]()

![]()

в среднем при подбрасывании кубика выпадает 3.5 очка

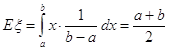

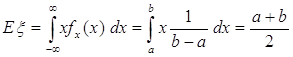

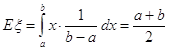

Пример 27. Пусть случайная величина ξ — координата точки, брошенной наудачу на отрезок [a,b]. Тогда

![]()

центр тяжести равномерного распределения на отрезке есть середина отрезка.

11.2 Свойства математического ожиданияВо всех свойствах предполагается, что рассматриваемые математические ожидания существуют.

E0. Математическое ожидание случайной величины есть ЧИСЛО!

E1. Для произвольной функции функция g : R® R

Доказательство. Мы докажем это свойство (как и почти все дальнейшие) только для дискретного распределения. Пусть g(ξ) принимает значения с1 с2 … с вероятностями

![]()

Тогда

![]()

E2 Математическое ожидание const равно этой const Eс = с.

E3. const можно вынести за знак математического ожидания: E(с ξ) = с Eξ.

Доказательство. Следует из свойства E1 при g(ξ) = с ξ .

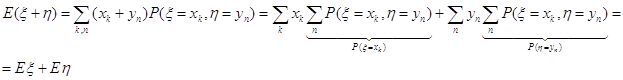

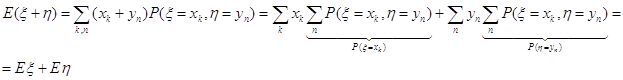

E4. Математическое ожидание суммы любых случайных величин ξ и η равно сумме их математических ожиданий.

E (ξ + η ) = E (ξ )+ E (η)

Доказательство. Для величин с дискретным распределением: пусть xk и yn — значения ξ и η, соответственно.

E5.Если ξ ³ 0 п.н. (« почти наверное», т.е. с вероятностью 1: P(ξ ³ 0 ) = 1), то E ξ ³ 0;

Если ξ ³ 0 п.н., и при этом Eξ = 0, то ξ = 0 п.н., то есть P(ξ = 0) = 1.

Следствие 11.

Если ξ £ η п.н., то E ξ £ Eη .

Если ξ £ η п.н., и при этом Eξ = Eη, то ξ = η п.н.

E6. Математическое ожидание произведения независимых случайных величин равно произведению их математических ожиданий.: если ξ и η независимы, то

E(ξη) = Eξ Eη.

Доказательство.

![]()

Замечание 16. Обратное утверждение к свойству E6 неверно: из равенства E(ξη) = Eξ Eη. Не следует независимость величин ξ и η.

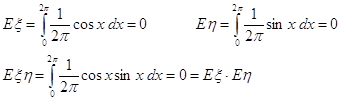

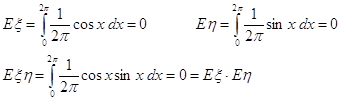

Пример 28. Пусть φ Î U0,2π, ξ = cos φ, η = sin φ— заведомо зависимые случайные величины. Но математическое ожидание их произведения равно произведению их математических ожиданий: по свойству E1

Определение 40. Если ![]() , то число

, то число

![]() называется моментом порядка k (k -м моментом) случайной величины ξ;

называется моментом порядка k (k -м моментом) случайной величины ξ;

![]() называется абсолютным моментом порядка k (абсолютным k -м моментом) случайной величины ξ;

называется абсолютным моментом порядка k (абсолютным k -м моментом) случайной величины ξ;

![]() называется центральным моментом порядка k (центральным k -м моментом) случайной величины ξ;

называется центральным моментом порядка k (центральным k -м моментом) случайной величины ξ;

![]() называется абсолютным центральным моментом порядка k (абсолютным центральным k -м моментом) случайной величины ξ.

называется абсолютным центральным моментом порядка k (абсолютным центральным k -м моментом) случайной величины ξ.

Число Dξ = E(ξ – Eξ)2 (центральный момент порядка 2) называется дисперсией случайной величины ξ

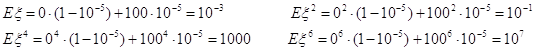

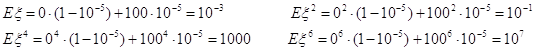

Пример 29. Пусть, скажем, случайная величина ξ принимает значение 0 с вероятностью 1-10-5 , и значение 100 с вероятностью 10-5. Посмотрим, как моменты разных порядков реагируют на большие, но маловероятные значения случайной величины.

Пример 30. Дисперсия Dξ = E(ξ – Eξ)2есть «среднее значение квадрата отклонения случайной величины ξ от своего среднего». Посмотрим, за что эта величина отвечает.

Пусть случайная величина ξ принимает значения +-1 с вероятностью 1/2, а случайная величина η — значения ю +-10 с вероятностью 1/2. Тогда Eξ = Eη = 0 поэтому D ξ = E ξ2 = 1, Dη = Eη2 = 100. Говорят, что дисперсия характеризует степень разброса значений случайной величины вокруг ее математического ожидания.

Если говорить о распределении случайной величины, как о распределении единичной массы по невесомому стержню, то дисперсия есть в точности момент инерции этого стержня, закрепленного в центре тяжести.

Определение 40. Если дисперсия величины ξ конечна, то число ![]() называют среднеквадратичным отклонением случайной величины ξ.

называют среднеквадратичным отклонением случайной величины ξ.

Следует хорошо понимать, что из существования моментов больших порядков следует существование моментов меньших порядков. В частности, конечность второго момента (или дисперсии) влечет существование математического ожидания.

11.4 Свойства дисперсииВсе свойства дисперсии следуют из соответствующих свойств математического ожидания.

D1. ![]()

Действительно,

![]()

D2. ![]()

D3.

![]() если и только если ξ= const.п.н.

если и только если ξ= const.п.н.

Доказательство. Дисперсия есть всего-навсего математическое ожидание п.н. неотрицательной с.в.:

Dξ = E(ξ – Eξ)2, и неотрицательность дисперсии следует из свойства E5. По тому же свойству, Dξ = 0 если и только если E(ξ – Eξ)2 = 0 п.н., то есть ξ = ξ п.н.

D4. Дисперсия не меняется от сдвига с.в. на постоянную:

![]()

D5. Если ξ и η независимы, то

![]()

Действительно,

![]()

так как математическое ожидание произведения независимых с.в. равно произведению их математических ожиданий.

D6. Минимум среднеквадратического отклонения случайной величины ξ от точек вещественной прямой есть среднеквадратическое отклонение ξ от своего математического ожидания:

![]()

Наименьший момент инерции стержня с распределенной на нем единичной массой получится, если точка вращения – центр тяжести стержня, а не любая другая точка.

Доказательство.

![]() причем равенство достигается только для а = Eξ.

причем равенство достигается только для а = Eξ.

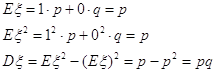

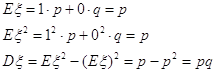

Пример 31. Распределение Бернулли Вр,

Пример 32. Биномиальное распределение Вn,p

Воспользуемся свойством устойчивости биномиального распределения относительно суммирования — леммой 5. Возьмем n независимых случайных величин ξ1 ξ2 … ξn, имеющих распределение Бернулли В,p = В1,p.

Тогда их сумма Sn= ξ1 + ξ2 +… + ξn имеет распределение Вn,p

![]()

так как все ξi одинаково распределены и их математическое ожидание равно pi;

![]()

поскольку ξi независимы и дисперсия каждой равна pq.

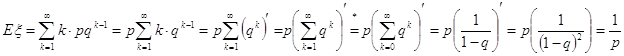

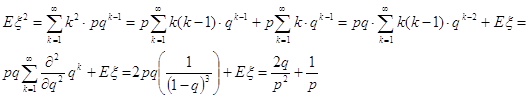

Пример 33. Геометрическое распределение Gp

При p Î (0,1)

Равенство (*) появилось из-за нежелания дифференцировать сумму геометрической прогрессии, которая начинается не с 0 а с q. Заметьте, что производная у добавленных слагаемых равна 0, так что производные от этих двух сумм равны

Поэтому

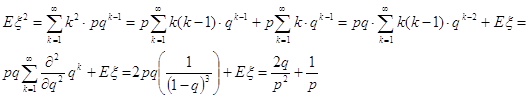

Пример 34. Распределение Пуассона Пλ

![]()

![]()

Показать, что

![]() , следовательно

, следовательно ![]()

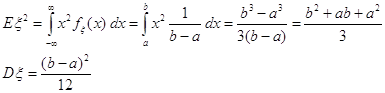

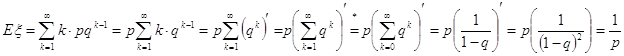

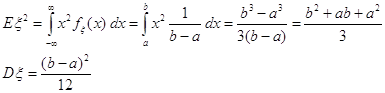

Пример 35. Равномерное распределение Ua,b

![]()

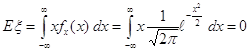

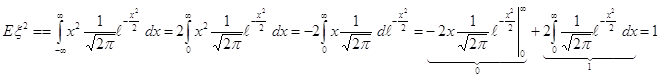

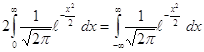

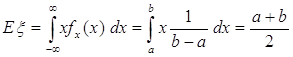

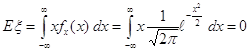

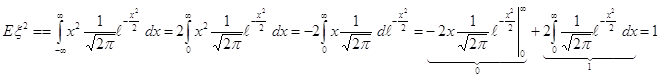

Пример 36. Стандартное нормальное распределение N0,1

поскольку под интегралом стоит нечетная функция, и сам интеграл абсолютно сходится (за счет быстро убывающей ![]()

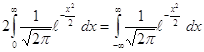

Последнее равенство следует из того, что

|

а интеграл по всей прямой от плотности любого распределения равен 1. Поэтому

![]()

Пример 37. Нормальное распределение ![]()

Мы знаем, что если

![]()

![]()

Поэтому

![]()

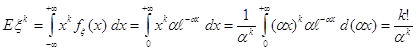

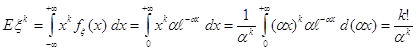

Пример 38. Показательное (экспоненциальное) распределение Еα

Найдем для произвольного k Î N момент порядка k.

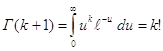

В последнем равенстве мы воспользовались гамма-функцией Эйлера:

Соответственно,

Соответственно,

![]()

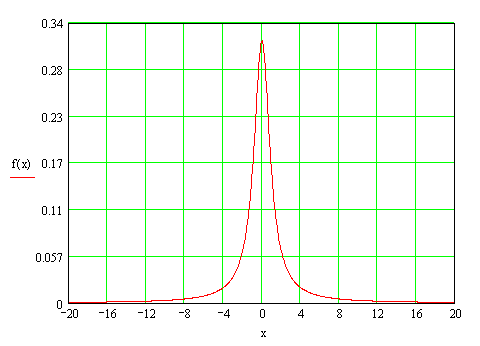

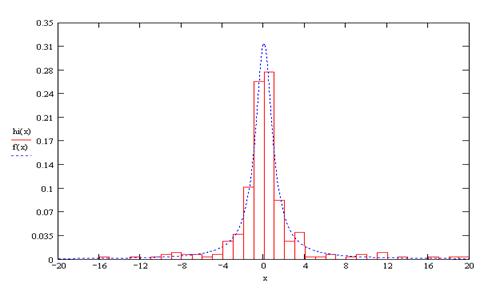

Пример 39. Стандартное распределение Коши С0,1

Распределение Коши. Говорят, что ξ имеет распределение Коши с параметрами α, σ2, где α Î R, σ > 0, если

![]() для всех х Î R

для всех х Î R

Распределение Коши имеет, например, абсцисса точки пересечения луча, посланного из точки (α, σ) под наудачу выбранным углом,

![]() с осью ОХ.

с осью ОХ.

Математическое ожидание для распределения Коши не существует, поскольку

![]()

расходится (подинтегральная функция ведет себя на бесконечности как 1/х).

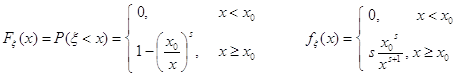

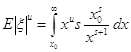

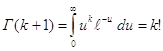

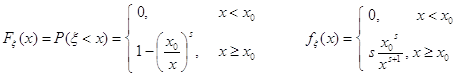

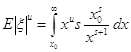

Пример 40. Распределение Парето

Распределение Парето. Говорят, что ξ имеет распределение Парето с параметрами х0, s, где х0 > 0, s > 0, если

У распределения Парето существуют только моменты порядка u < s, поскольку

сходится при u < s, то есть когда подинтегральная функция на бесконечности бесконечно мала по сравнению с 1/х.

«Случайных величин без мат. ожидания не бывает, так как, если у нас есть случайная величина мы всегда в праве от нее что-нибудь ожидать.»

Из студенческой контрольной работы.

Раздел 11. Числовые характеристики случайных величин 11.1 Математическое ожидание случайной величиныОпределение 38. Математическим ожиданием Eξ (средним значением, первым моментом) случайной величины ξ с дискретным распределением, задаваемым таблицей P(ξ = аi) = pi, называется число

![]() если указанный ряд абсолютно сходится.

если указанный ряд абсолютно сходится.

Если же

![]() , то говорят, что математическое ожидание не существует.

, то говорят, что математическое ожидание не существует.

Определение 39. Математическим ожиданием Eξ случайной величины ξ с абсолютно непрерывным распределением с плотностью распределения fξ(x), называется число

![]() если указанный интеграл абсолютно сходится.

если указанный интеграл абсолютно сходится.

Если же

![]() , то говорят, что математическое ожидание не существует.

, то говорят, что математическое ожидание не существует.

Математическое ожидание имеет простой физический смысл: если на прямой разместить единичную массу, поместив в точку аi массу pi (для дискретного распределения), или «размазав» ее с плотностью fξ(x) (для абсолютно непрерывного распределения), то точка Eξ есть координата «центра тяжести» прямой.

Пример 26. Пусть случайная величина ξ равна числу очков, выпадающих при одном подбрасывании кубика. Тогда

![]()

![]()

![]()

в среднем при подбрасывании кубика выпадает 3.5 очка

Пример 27. Пусть случайная величина ξ — координата точки, брошенной наудачу на отрезок [a,b]. Тогда

![]()

центр тяжести равномерного распределения на отрезке есть середина отрезка.

11.2 Свойства математического ожиданияВо всех свойствах предполагается, что рассматриваемые математические ожидания существуют.

E0. Математическое ожидание случайной величины есть ЧИСЛО!

E1. Для произвольной функции функция g : R® R

Доказательство. Мы докажем это свойство (как и почти все дальнейшие) только для дискретного распределения. Пусть g(ξ) принимает значения с1 с2 … с вероятностями

![]()

Тогда

![]()

E2 Математическое ожидание const равно этой const Eс = с.

E3. const можно вынести за знак математического ожидания: E(с ξ) = с Eξ.

Доказательство. Следует из свойства E1 при g(ξ) = с ξ .

E4. Математическое ожидание суммы любых случайных величин ξ и η равно сумме их математических ожиданий.

E (ξ + η ) = E (ξ )+ E (η)

Доказательство. Для величин с дискретным распределением: пусть xk и yn — значения ξ и η, соответственно.

E5.Если ξ ³ 0 п.н. (« почти наверное», т.е. с вероятностью 1: P(ξ ³ 0 ) = 1), то E ξ ³ 0;

Если ξ ³ 0 п.н., и при этом Eξ = 0, то ξ = 0 п.н., то есть P(ξ = 0) = 1.

Следствие 11.

Если ξ £ η п.н., то E ξ £ Eη .

Если ξ £ η п.н., и при этом Eξ = Eη, то ξ = η п.н.

E6. Математическое ожидание произведения независимых случайных величин равно произведению их математических ожиданий.: если ξ и η независимы, то

E(ξη) = Eξ Eη.

Доказательство.

![]()

Замечание 16. Обратное утверждение к свойству E6 неверно: из равенства E(ξη) = Eξ Eη. Не следует независимость величин ξ и η.

Пример 28. Пусть φ Î U0,2π, ξ = cos φ, η = sin φ— заведомо зависимые случайные величины. Но математическое ожидание их произведения равно произведению их математических ожиданий: по свойству E1

Определение 40. Если ![]() , то число

, то число

![]() называется моментом порядка k (k -м моментом) случайной величины ξ;

называется моментом порядка k (k -м моментом) случайной величины ξ;

![]() называется абсолютным моментом порядка k (абсолютным k -м моментом) случайной величины ξ;

называется абсолютным моментом порядка k (абсолютным k -м моментом) случайной величины ξ;

![]() называется центральным моментом порядка k (центральным k -м моментом) случайной величины ξ;

называется центральным моментом порядка k (центральным k -м моментом) случайной величины ξ;

![]() называется абсолютным центральным моментом порядка k (абсолютным центральным k -м моментом) случайной величины ξ.

называется абсолютным центральным моментом порядка k (абсолютным центральным k -м моментом) случайной величины ξ.

Число Dξ = E(ξ – Eξ)2 (центральный момент порядка 2) называется дисперсией случайной величины ξ

Пример 29. Пусть, скажем, случайная величина ξ принимает значение 0 с вероятностью 1-10-5 , и значение 100 с вероятностью 10-5. Посмотрим, как моменты разных порядков реагируют на большие, но маловероятные значения случайной величины.

Пример 30. Дисперсия Dξ = E(ξ – Eξ)2есть «среднее значение квадрата отклонения случайной величины ξ от своего среднего». Посмотрим, за что эта величина отвечает.

Пусть случайная величина ξ принимает значения +-1 с вероятностью 1/2, а случайная величина η — значения ю +-10 с вероятностью 1/2. Тогда Eξ = Eη = 0 поэтому D ξ = E ξ2 = 1, Dη = Eη2 = 100. Говорят, что дисперсия характеризует степень разброса значений случайной величины вокруг ее математического ожидания.

Если говорить о распределении случайной величины, как о распределении единичной массы по невесомому стержню, то дисперсия есть в точности момент инерции этого стержня, закрепленного в центре тяжести.

Определение 40. Если дисперсия величины ξ конечна, то число ![]() называют среднеквадратичным отклонением случайной величины ξ.

называют среднеквадратичным отклонением случайной величины ξ.

Следует хорошо понимать, что из существования моментов больших порядков следует существование моментов меньших порядков. В частности, конечность второго момента (или дисперсии) влечет существование математического ожидания.

11.4 Свойства дисперсииВсе свойства дисперсии следуют из соответствующих свойств математического ожидания.

D1. ![]()

Действительно,

![]()

D2. ![]()

D3.

![]() если и только если ξ= const.п.н.

если и только если ξ= const.п.н.

Доказательство. Дисперсия есть всего-навсего математическое ожидание п.н. неотрицательной с.в.:

Dξ = E(ξ – Eξ)2, и неотрицательность дисперсии следует из свойства E5. По тому же свойству, Dξ = 0 если и только если E(ξ – Eξ)2 = 0 п.н., то есть ξ = ξ п.н.

D4. Дисперсия не меняется от сдвига с.в. на постоянную:

![]()

D5. Если ξ и η независимы, то

![]()

Действительно,

![]()

так как математическое ожидание произведения независимых с.в. равно произведению их математических ожиданий.

D6. Минимум среднеквадратического отклонения случайной величины ξ от точек вещественной прямой есть среднеквадратическое отклонение ξ от своего математического ожидания:

![]()

Наименьший момент инерции стержня с распределенной на нем единичной массой получится, если точка вращения – центр тяжести стержня, а не любая другая точка.

Доказательство.

![]() причем равенство достигается только для а = Eξ.

причем равенство достигается только для а = Eξ.

Пример 31. Распределение Бернулли Вр,

Пример 32. Биномиальное распределение Вn,p

Воспользуемся свойством устойчивости биномиального распределения относительно суммирования — леммой 5. Возьмем n независимых случайных величин ξ1 ξ2 … ξn, имеющих распределение Бернулли В,p = В1,p.

Тогда их сумма Sn= ξ1 + ξ2 +… + ξn имеет распределение Вn,p

![]()

так как все ξi одинаково распределены и их математическое ожидание равно pi;

![]()

поскольку ξi независимы и дисперсия каждой равна pq.

Пример 33. Геометрическое распределение Gp

При p Î (0,1)

Равенство (*) появилось из-за нежелания дифференцировать сумму геометрической прогрессии, которая начинается не с 0 а с q. Заметьте, что производная у добавленных слагаемых равна 0, так что производные от этих двух сумм равны

Поэтому

Пример 34. Распределение Пуассона Пλ

![]()

![]()

Показать, что

![]() , следовательно

, следовательно ![]()

Пример 35. Равномерное распределение Ua,b

![]()

Пример 36. Стандартное нормальное распределение N0,1

поскольку под интегралом стоит нечетная функция, и сам интеграл абсолютно сходится (за счет быстро убывающей ![]()

Последнее равенство следует из того, что

|

а интеграл по всей прямой от плотности любого распределения равен 1. Поэтому

![]()

Пример 37. Нормальное распределение ![]()

Мы знаем, что если

![]()

![]()

Поэтому

![]()

Пример 38. Показательное (экспоненциальное) распределение Еα

Найдем для произвольного k Î N момент порядка k.

В последнем равенстве мы воспользовались гамма-функцией Эйлера:

Соответственно,

Соответственно,

![]()

Пример 39. Стандартное распределение Коши С0,1

Распределение Коши. Говорят, что ξ имеет распределение Коши с параметрами α, σ2, где α Î R, σ > 0, если

![]() для всех х Î R

для всех х Î R

Распределение Коши имеет, например, абсцисса точки пересечения луча, посланного из точки (α, σ) под наудачу выбранным углом,

![]() с осью ОХ.

с осью ОХ.

Математическое ожидание для распределения Коши не существует, поскольку

![]()

расходится (подинтегральная функция ведет себя на бесконечности как 1/х).

Пример 40. Распределение Парето

Распределение Парето. Говорят, что ξ имеет распределение Парето с параметрами х0, s, где х0 > 0, s > 0, если

У распределения Парето существуют только моменты порядка u < s, поскольку

сходится при u < s, то есть когда подинтегральная функция на бесконечности бесконечно мала по сравнению с 1/х.

Раздел 12. Числовые характеристики зависимости случайных величин 12.1 Чем отличается дисперсия суммы от суммы дисперсий?Мы знаем, что для независимых с. в. с конечными вторыми моментами дисперсия их суммы равна сумме их дисперсий. Чему равна дисперсия суммы в общем случае?

![]() (10)

(10)

Величина E(ξη) - Eξ Eη равняется нулю, если случайные величины ξ и η независимы (свойство E6 математического ожидания). С другой стороны, из равенства ее нулю вовсе не следует независимость, как показывает пример 30. Оказывается, что эту величину часто используют как «индикатор наличия зависимости» пары с. в.

Определение 41. Ковариацией cov(ξ, η) случайных величин ξ и η называется число

![]()

Свойство 10.

![]()

Свойство 11.

a) ![]() ;

;

b) ![]() .

.

Свойство 12. Дисперсия суммы нескольких случайных величин вычисляется по любой из следующих формул:

![]()

Обсудим достоинства и недостатки ковариации, как величины, характеризующей зависимость двух с. в.

Похожие работы

... мышц и скоростью их сокращения, между спортивным достижением в одном и другом виде спорта и так далее. Теперь можно составить содержание элективного курса «Основы теории вероятностей и математической статистики» для классов оборонно-спортивного профиля. 1. Комбинаторика. Основные формулы комбинаторики: о перемножении шансов, о выборе с учетом порядка, перестановки с повторениями, размещения с ...

... случайная величина приобрела статус полноценного математического понятия, ей необходимо дать строго формализованное определение. Это было сделано в конце 20-х годов А.Н. Колмогоровым в небольшой статье, посвященной аксиоматике теории вероятностей, а затем в подробностях изложено в его знаменитой книге «Основные понятия теории вероятностей». Подход Колмогорова стал теперь общепринятым, поскольку он ...

... 400 интервалов). Решение: Построим график плотности распределения по закону Коши (): Рис.2. График распределения Коши. Необходимо разбить интервал от –20 до 20 на n подинтервалов (в данном случае n=40) и вычислить вероятность попадания на каждый из этих подинтервалов. После этого составить массив [a1,aj], так чтобы a1=0, a , случайно сгенерировать значение числа «b» из промежутка от 0 ...

... , причём i – заводпоставляет mi% изделий (i = 1, 2, 3). Среди изделий i – го завода n1% первосортных. Куплено одно изделие. Оно оказалось первосортным. Определить вероятность того, что купленное изделие выпущено i – заводом. m1 = 60 m2 = 20 m3 = 20 n1 = 70 n2 = 80 n3 = 90 Пусть: H1 – поставил первый завод H2 – поставил второй завод H3 – поставил третий завод Пусть: ...

0 комментариев