Навигация

МОДЕЛИ СЛУЧАЙНЫХ СИГНАЛОВ

1.8. МОДЕЛИ СЛУЧАЙНЫХ СИГНАЛОВ.

Величина, которая в каждом определенном случае в зависимости от результатов опыта может принимать то или иное числовое значение, называется случайной величиной. Конкретное значение, которое может принять случайная величина, называется возможным ее значением. Случайную величину можно определить как, функцию заданную на пространстве элементарных событий.

Случайные величины обозначают большими буквами латинского алфавита X,Y,Z,.., а возможные их значения соответствующими буквами x, y, z,...,. Случайная величина зависит, от элементарного события. Этот факт обозначается следующим образом Х=Х(ω).

Случайная величина, множество значений которой конечно или счетною, называется дискретной, случайной величиной.

ВЕКТОРНЫЕ (МНОГОМЕРНЫЕ) СЛУЧАИНЫЕ ВЕЛИЧИНЫ.

Кроме одномерных, случайных величин можно рассматривать многомерные, случайные векторы, координаты которых являются одномерными, случайными величинами. Такие случайные величины встречаются во многих технических задачах.

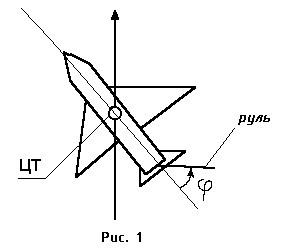

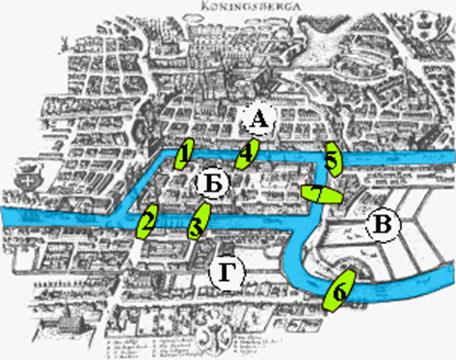

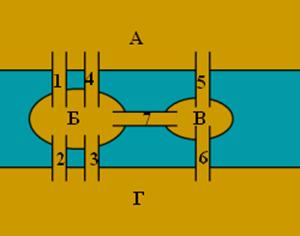

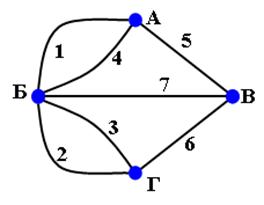

Случайные сигналы G и Х на входе и выходе системы автоматического регулирования (САР) с n -выходами и m -входами можно рассматривать n- и m- мерные, случайные векторы (рис 1)

|

|

![]()

![]()

![]()

![]() g2

x2

g2

x2

![]()

![]() X G

X G

gn xn![]()

![]()

GT=[g1,g2,...,gn] XT=[x1,x2,...,xn]

Случайные векторные величины будем обозначать жирными буквами латинского алфавита X,Y,Z, . Рассмотрим совокупность n случайных величин x1( ), x ( ),.., x ( )заданных на пространстве элементарных событий. Эти величины можно интегрировать как одну векторную, случайную величину:

(1) XT(ω)=[x1(ω),...,xn(ω)]

Случайная векторная величина принимает каждый раз значения, зависящие от элементарного события. Таким образом, многомерная, случайная величина есть вектор-функция, заданная на пространстве элементарных событий, и каждое ее возможное значение есть вектор.

ЧИСЛОВЫЕ ХАРАКТЕРИСТИКИ (МОМЕНТЫ) СЛУЧАЙНЫХ ВЕЛИЧИН.

Полными характеристиками случайных величин являются их функции распределения или плотности распределения вероятностей. Однако многие задачи теории вероятности можно решать, не используя функции распределения вероятностей. Оказывается, что статические свойства случайных величин могут быть описаны на основе числовых характеристик распределения этих случайных величин. Одной из наиболее важных числовых характеристик случайной величины является ее среднее значение, называемое также математическим ожиданием.

Математическим ожиданием М [Х] случайной величины Х называется число, определяемое интегралом вида:

∞

(2) mX=M[X]=⌡ xf(x)dx

-∞

где f(х) - плотность распределения вероятностей случайной величины Х, х - возможные ее значения.

Для дискретной, случайной величины Х, плотность распределения вероятностей есть сумма дельта - функций получим:

n n

(3) M[X]=x ∑ pk δ(x-xk)dx= ∑ xk pk

k=1 k=1

здесь хk возможное значение случайной величины, pk- вероятность того, что случайная величина примет значение хк.

Из равенства (3) следует, что математическое ожидание случайной дискретной величины Х равно сумме произведений возможных значений, принимаемых случайной величиной, на соответствующие им вероятности.

Отсюда вытекает вероятностный смысл математического ожидания, оно определяет координату центра группирования значений, принимаемых случайной величиной; следовательно, математическое ожидание является средним значением случайной величины.

Для непрерывной, случайной величины каждому ее возможному значению х соответствует элементарная вероятность f(х)dx . Если задана случайная величина Y, которая является неслучайной функцией Y=Ψ(x) случайного дискретного элемента Х, то Y принимает возможные значения уk=Ψ(хk) с вероятностями pk; поэтому математическое ожидание случайной величины Y=Ψ(х) аналогично равенству (3).

n

(4) M[Ψ(x)]= ∑ Ψ(xk)pk

k=1

Если Х - непрерывная, случайная величина, то функция от этой величины Y=Ψ(х) принимает возможные значенияΨ(x) с вероятностями f(х)dх. В этом случае сумма (4) после предельного перехода равна соответствующему интегралу:

∞

(5) M[Ψ(x)]= ⌡ Ψ(x)f(x)dx

-∞

Пологая, в формуле (5) Ψ(х)=хn получим выражение для моментов случайных величин Х.

Начальным моментом (или просто моментом) случайной величины Х называется математическое ожидание ее, n-ной степени. Этот момент обозначается αn т.е.

∞

(6) αn=M[Xn]= ⌡ xn f(x)dx

-∞

Очевидно, математическое ожидание не может дать полное представление о случайной величине, т.к. характеризует только ее среднее значение:

![]()

![]()

![]() * * * * **** x1

* * * * **** x1

0 m

![]()

![]()

![]() * *** *** * x2

* *** *** * x2

0 m

На рисунке 2 крестиками показаны значения, которые приняли случайные величины х1, х2. Эти случайные величины имеют одинаковые математические ожидания M[x1]=M[x2]=m, но разброс значений, который имеет случайная величина х2 около своего математического ожидания, больше чем разброс значений случайной величины х1.

Для характеристики величины разброса значений случайной величины около математического ожидания вводится еще одна характеристика случайной величины, равная сумме произведений квадратов отклонений, возможных значений случайной величины от математического ожидания на соответствующие этим возможным значениям вероятности.

Такая числовая характеристика называется дисперсией случайной величины Х и обозначается D[Х]. Для дисперсии случайной величины Х имеем:

n

(7) D[X]= ∑ (xk-M[X])2 pk

k=1

Очевидно, что чем больше дисперсия, тем больше разброс возможных значений случайной величины от математического ожидания. Из выражения (6) следует, что дисперсия есть математическое ожидание квадрата разности случайной величины и ее математического ожидания.

Для непрерывной, случайной величины Х формула (6) после предельного перехода принимает вид:

∞

(8) D[X]=M(X-M[X])2= ⌡ (x-M[X])2 f(x)dx

-∞

Разность между случайной величиной и ее математическим ожиданием называется центрированной случайной величиной Х○.

(9) X○=X-M[X]

Центральным моментом n-го порядка случайной величины Х называется математическое ожидание n-ой степени интегрированной случайной величины Х○, т.е.

∞

(10) μn=M[(X○)n]=M[X-M[X]n]= ⌡ (x-M[X]n) f(x)dx

-∞

Из формул (8), (9) следует, что дисперсия является центральным моментом второго порядка случайной величины. Дисперсия случайной величины имеет разность квадрата этой величины, однако, удобнее пользоваться мерой разброса случайной величины, имеющей ту же размерность, что и сама случайная величина. За эту меру принимают положительное значение квадратного корня из дисперсии и называют ее средним квадратичным отклонением.

![]()

![]() (11) δx=√ D[X] = √ μx

(11) δx=√ D[X] = √ μx

МОМЕНТЫ МНОГОМЕРНЫХ СЛУЧАЙНЫХ ВЕЛИЧИН.

Как и для одномерных, случайных величин, для случайных векторов вводят понятие начального и центрального моментов. Рассмотрим случайный n-мерный вектор - столбец Х с координатами х1, х2,...,хn

Смешанным начальным моментом порядка k1+k2 +,...,+kn случайных, величин х1, .. , хn называется математическое ожидание произведения

(12) αk1, k2,..., kn=M[x1k1, x2k2,..., xnkn]

![]() Смешанным центральным моментом порядка k1, k2,..., kn случайных, величин х1 ,..,хn называется математическое ожидание произведения (x1○)k1(x2○)k2..(xn○)kn соответствующих центрированных случайных величин т.е.

Смешанным центральным моментом порядка k1, k2,..., kn случайных, величин х1 ,..,хn называется математическое ожидание произведения (x1○)k1(x2○)k2..(xn○)kn соответствующих центрированных случайных величин т.е.

(13) μk1, k2,..., kn=M[(x1○)k1(x2○)k2...(xn○)kn]

Вычислим момент первого порядка для координат вектора X

(14) α0,..,0,1,0,..,0=M[(x1)○...(xi-1)○ xi (xi+1)○...(xn)○=M[xi]

Отсюда, следует, что начальные моменты первого порядка для системы n-случайных величин, есть математическое ожидание этих случайных величин.

Математическим ожиданием случайного вектора Х называется вектор, координатами которого являются математические ожидания соответствующих координат случайного вектора Х, т.е.

(15) M[X]T=M[x1]...M[xn]

Рассмотрим момент второго порядка, пусть имеем две случайные величины хi, уi. Вычислим смешанный центральный момент второго порядка. Согласно равенству (13) имеем:

(16) μ1,1=M(xi○yj○)

Смешанный центральный момент второго порядка случайных величин называется корреляционным моментом и обозначается Кij.

Кроме корреляционного момента двух случайных величин, для характеристики связи случайных величин введем безразмерный коэффициент rij, равный отношению корреляционного момента Kij случайных величин хi, уj к положительному значению квадратного корня из произведения дисперсией этих случайных величин. Этот коэффициент называется коэффициентом корреляции случайных величин т. е.

![]()

![]()

![]() Kij

Kij

(18) rij= √D[xi]D[xj]

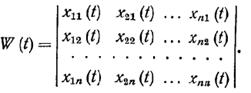

Рассмотрим случайный вектор Х с коэффициентами х1, х2,.., хn. Матрица К, составленная из корреляционных моментов для всех координат этого случайного вектора:

![]()

![]() k11 k12 ......k1n

k11 k12 ......k1n

k21 k22 ......k2n

(19) K= ...................... =M[X○(X○)T]=[M[Xi○Xj○]]

kn1 kn2 ......knn

называется корреляционной матрицей случайного вектора Х. из свойств корреляционного момента следует, что Кij=Кji, т.е. матрица К является симметричной:

(20) КT=К

Пусть выполняется линейное преобразование случайного вектора Х, задаваемого в некотором базисе матрицей В, т.е.

(21) Y=ВХ

При линейном преобразовании (21) случайного вектора Х корреляционная матрица Y равна Кy=ВКxВT (22)

КОВАРЦИОННАЯ МАТРИЦА.

Если имеется не две, а большее число случайных величин, например, х1,...,хn, то резко возрастает и число числовых параметров, характеризующих эти величины. Кроме n-первых моментов, определяющих математическое ожидание случайных величин необходимо определение еще вторых центральных моментов, представляющих собой дисперсии каждой случайной величины и коварцией между каждой парой случайных величин. Всю совокупность случайных величин Х1,..., Хn, удобно представить в виде случайного вектора столбца:

![]()

![]() X1

__ __

X1

__ __

(23) X= ....... =(X1,...,Xn)T

Xn

Тогда совокупность математических ожиданий компонент этого вектора запишем в виде вектора математических ожиданий:

![]()

![]() x1

__ __

x1

__ __

(24) X=M[X]= ...... =(x1,...,xn)T

xn

Совокупность вторых центральных моментов, представляющих собой дисперсии:

(25) δ2xi=M[(xi-M[x])2] , i=1,...,n

и коварции

(26) cov(xixj)=M[(xi-M[xi])(xj-M[xj]) ,i, j=1,...,n, i≠j

Удобно записать в виде коварционной матрицы:

(27) Pxx=M[(X-M(X))(X-M(X)T)]

Диагональные члены этой матрицы представляют собой дисперсии. Коварционная матрица является симметричной.

ЭЛЕМЕНТЫ ТЕОРИИ СЛУЧАЙНЫХ ФУНКЦИЙ.

При изучении ряда явлений природы приходится наблюдать процессы, характеризуемые функциями, которые в зависимости от исхода опыта принимают различный вид. Указать заранее на то, какой вид примет случайная функция в данном опыте, невозможно, однако закономерности, присущие множеству значений, принимаемые случайной функцией, как закономерности массового явления можно изучить. Случайная функция как случайная величина, принимает различные значения в зависимости от исхода опыта элементарного события, кроме того, случайная функция зависит от некоторого неслучайного параметра t, например времени.

Если параметр t- время, то случайную функцию называют случайным процессом. Если зафиксировать элементарное событие ω=ω0, то Х(t,ω0) будет неслучайной функцией аргумента t. Конкретный вид случайной функции при фиксированном, т.е. возможном опыте, называется реализацией случайной функции.

Если зафиксировать параметр случайной функции t, т.е. рассмотреть сечение этой случайной функции при t=tk, то она будет зависеть только от элементарного события и, следовательно, станет случайной величиной Х(tk,ω).

Чтобы полностью задать случайную функцию Х(t), надо знать все n-мерные функции распределения: Fn(x1,...,xn; t1,..,tn), которые зависят от n переменных х1,...,хn и значений t1,...,tn, или плотности распределения вероятностей fn.

Важными характеристиками случайных величин являются моменты. Если известна двумерная функция распределения или плотность распределения вероятностей случайной функции, то всегда можно вычислить моменты случайной функции до второго порядка включительно, такими моментами являются математически ожидания;

∞

(1) M[X(t)]= ⌡ xf1[x,t]dx=mx(t)

-∞

дисперсия

∞

(2) D[X(t)]= ⌡ [x-mx(t)]2f1(x,t)dx=D1(t)

-∞

и корреляционный момент:

∞ ∞

(3) Kx(t1,t2)=M[X○(t1)X○(t2)]= ⌡ ⌡ (x1-mx(t1))(x2-mx(t2))

-∞ -∞

f2(x1,x2;t1,t2)dx1dx2, где

(4) X○(t)=X(t)-M[X(t)], центрированная случайная функция.

Если параметру t придавать все возможные значения, то математическое ожидание (1) и дисперсия (2) случайной функции будут функциями одной переменной t, а корреляционный момент (3) функцией двух переменных t1 и t2. Корреляционный момент Кx(t1,t2) называется корреляционной функцией случайной функции Х(t).

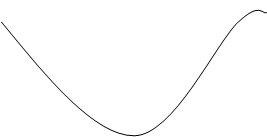

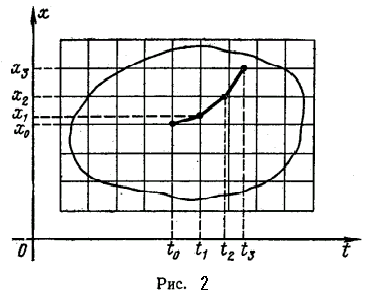

Математическое ожидания представляет собой среднее значение случайной функции Х(t)рис 2, а дисперсия характеризует отклонение значений, принимаемых случайной функцией, от ее математического ожидания.

Корреляционная функция характеризует зависимость между случайными величинами Х(t1) и Х(t2)-сечениями случайной функции при t=t1 и t=t2.

![]() x(t)

x(t)

![]() m(x)

m(x)

![]() t

t

Рис 2

Теория, изучающая случайные функции на основе знания первых двух моментов случайных функций, рис 2 называется корреляционной теорией.

Если известны математическое ожидание m(t) и корреляционная функция К(t1,t2) случайной функции Х(t), то всегда можно построить n-мерный вектор математического ожидания многомерной, случайной величины x(t1),...,x(tn) для фиксированных значений t1, t2,...,tn.

(5) mT=[m1, m2,..., mn]

и корреляционную матрицу этой случайной многомерной величины

![]()

![]() K(t1,t1) K(t1,t2) ..... K(t1,tn)

K(t1,t1) K(t1,t2) ..... K(t1,tn)

K(t2,t1) k(t2,t2) ..... K(t2,tn)

(6) K= ........................................

........................................

K(tn,t1) K(tn,t2) K(tn,tn)

НЕКОТОРЫЕ СВОЙСТВА КОРРЕЛЯЦИОННОЙ ФУНКЦИИ.

1. Корреляционная функция при одинаковых значениях аргументов равна дисперсии случайной функции, т.е.

K(t,t)=D(t)

2. При перемене местами аргументов корреляционная функция меняется на комплексно - сопряженную, т.е.

______

K(t1; t2)=K(t1, t2)

![]()

![]()

![]() 3. Для всякой корреляционной функции справедливо неравенство:

3. Для всякой корреляционной функции справедливо неравенство:

1) K(t1, t2) ≤√ D(t1)D(t2)

4. Корреляционная функция является положительно определенной функцией. Вместо корреляционной функции может быть рассмотрена безразмерная нормированная корреляционная функция R(t1, t2) определяемая равенством;

(t1, t2)

(5) ![]() R(t1, t2)=

R(t1, t2)=

![]() √ D(t1)D(t2)

√ D(t1)D(t2)

Из определения свойств корреляционной функции можно показать, что для нормированной корреляционной функции справедливо состояние:

_____ ______

R(t, t)=1 , R(t2,t1)=R(t1,t2) , R(t1,t2)≤1

В теории случайных чисел большую роль играет один из видов случайной функции, математическое ожидание которой равно 0, а корреляционная функция равна дельта функции. Такую случайную функцию называют белым шумом. Для белого шума как это следует из определения, справедливы равенства:

(6) M[X(t)=0

(7) K(t1, t2)=G(t) δ(t1-t2)

Функция G(t) называется интенсивностью белого шума. Дельта-функция при значении аргумента, отличном от 0, равна 0, поэтому для белого шума случайные величины, соответствующие двум сколь угодно близким значениям, являются некоррелированными.

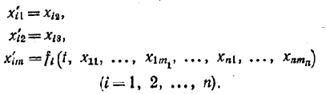

Рассмотри систему из n случайных функций:

(8) X1(t),X2(t),...,Xn(t)

Каждая из функций этой системы характеризуется математическим ожиданием и корреляционной функцией. Однако необходимо еще ввести характеристику связи между отдельными случайными функциями системы (8).

Такой характеристикой является взаимная корреляционная функция двух случайных функций Xi(t) и Xi(t), и определяется равенством:

(9) Kxixj(t1,t2)=M[Xi○(t)Xj○(t)]

Для того, чтобы отличать взаимную корреляционную функцию, от корреляционной функции, последнюю называют также автокорреляционной.

Для взаимной корреляционной функции случайных функций Хi(t) и Yj(t) справедливы свойства:

________

(10) Kxy(t1, t2)=Kxy(t1, t2)

![]()

![]()

![]() (11) Kxy(t1, t2) ≤ √Dx(t1)Dy(t2)

(11) Kxy(t1, t2) ≤ √Dx(t1)Dy(t2)

Две случайные функции Х(t) и Y(t) называются некоррелированными, если их взаимная корреляционная функция тождественно равна нулю т.е.

(12) Kxy(t1, t2)=0

В ряде случаев удобно ввести безразмерную характеристику связи между случайными функциями нормированную взаимную корреляционную функцию:

Kxy(t1,t1)

![]() (13) Rxy(t1, t2)=

(13) Rxy(t1, t2)=

![]() √ Dx(t1)Dy(t1)

√ Dx(t1)Dy(t1)

ЛИНЕЙНЫЕ ОПЕРАЦИИ НАД СЛУЧАЙНЫМИ ФУНКЦИЯМИ.

Выясним, как образуются математические ожидания и корреляционные функции случайных функций при осуществлении над ними линейных операций:

Похожие работы

... D=1- W3W4(W1W5W6+ W7+ W1W8+ W2W6 W7+ W2W7+2W2W8+ 1)+ W5W6(W3W4(W7+ W1W5W6+ W2W7+ W2W8+1)-1) Для x1 Для x4 Для y Для х13 Задание 2. Синтез комбинационных схем. 2.1 Определение поставленной задачи Устройство, работа которого может быть представлена на языке алгебры высказываний, принято называть логическим. Пусть такое устройство имеет n ...

... противоположные подходы, но нельзя считать ни один из них "юридически законным" или вытекающим из каких ни будь законов природы, нельзя считать стиль управления системой на основе системного анализа "правильным", "современным", "куль-турным". Другое дело — не знать о возможности применения системного подхода к вопросам управления — вот это неправильно, некультурно. Пример системного подхода ...

... в момент t, образует пространство выхода системы. Множество всех значений, которые может принять вектор состояния x в момент t, образует пространство состояний системы. 3.3. Описание непрерывных систем с помощью системы дифференциальных уравнений В любой момент времени t состояние системы является функцией начального состояния x(t0) и вектора входа m(t0, t), то есть x(t)=F[x(t0); m(t0; t)], ...

... Рассела и во многом базируется на работе Бертрана Рассела и Альфреда Уайтхэда «Principia Mathematica» (этот фундаметальный трёхтомник математической логики до сих пор не издан на русском языке)[8]. Заключение Прародителем информатики является кибернетика, основанная американским математиком Норбертом Винером, опубликовавшим в 1948 году одноименную книгу. Основоположником ...

0 комментариев